導讀

介紹使圖像分割的方法,包括傳統方法和深度學習方法,以及應用場景。

基于人工智能和深度學習方法的現代計算機視覺技術在過去10年里取得了顯著進展。如今,它被用于圖像分類、人臉識別、圖像中物體的識別、視頻分析和分類以及機器人和自動駕駛車輛的圖像處理等應用上。

許多計算機視覺任務需要對圖像進行智能分割,以理解圖像中的內容,并使每個部分的分析更加容易。今天的圖像分割技術使用計算機視覺深度學習模型來理解圖像的每個像素所代表的真實物體,這在十年前是無法想象的。

深度學習可以學習視覺輸入的模式,以預測組成圖像的對象類。用于圖像處理的主要深度學習架構是卷積神經網絡(CNN),或者是特定的CNN框架,如AlexNet、VGG、Inception和ResNet。計算機視覺的深度學習模型通常在專門的圖形處理單元(GPU)上訓練和執行,以減少計算時間。

什么是圖像分割?

圖像分割是計算機視覺中的一個關鍵過程。它包括將視覺輸入分割成片段以簡化圖像分析。片段表示目標或目標的一部分,并由像素集或“超像素”組成。圖像分割將像素組織成更大的部分,消除了將單個像素作為觀察單位的需要。圖像分析有三個層次:

分類

將整幅圖片分成“人”、“動物”、“戶外”等類別

目標檢測 檢測圖像中的目標并在其周圍畫一個矩形,例如一個人或一只羊。

分割 識別圖像的部分,并理解它們屬于什么對象。分割是進行目標檢測和分類的基礎。

語義分割 vs. 實例分割

在分割過程本身,有兩個粒度級別:

語義分割將圖像中的所有像素劃分為有意義的對象類。這些類是“語義上可解釋的”,并對應于現實世界的類別。例如,你可以將與貓相關的所有像素分離出來,并將它們涂成綠色。這也被稱為dense預測,因為它預測了每個像素的含義。

實例分割

標識圖像中每個對象的每個實例。它與語義分割的不同之處在于它不是對每個像素進行分類。如果一幅圖像中有三輛車,語義分割將所有的車分類為一個實例,而實例分割則識別每一輛車。

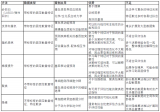

傳統的圖像分割方法

還有一些過去常用的圖像分割技術,但效率不如深度學習技術,因為它們使用嚴格的算法,需要人工干預和專業知識。這些包括:

閾值

將圖像分割為前景和背景。指定的閾值將像素分為兩個級別之一,以隔離對象。閾值化將灰度圖像轉換為二值圖像或將彩色圖像的較亮和較暗像素進行區分。

K-means聚類

算法識別數據中的組,變量K表示組的數量。該算法根據特征相似性將每個數據點(或像素)分配到其中一組。聚類不是分析預定義的組,而是迭代地工作,從而有機地形成組。

基于直方圖的圖像分割

使用直方圖根據“灰度”對像素進行分組。簡單的圖像由一個對象和一個背景組成。背景通常是一個灰度級,是較大的實體。因此,一個較大的峰值代表了直方圖中的背景灰度。一個較小的峰值代表這個物體,這是另一個灰色級別。

邊緣檢測識別亮度的急劇變化或不連續的地方。邊緣檢測通常包括將不連續點排列成曲線線段或邊緣。例如,一塊紅色和一塊藍色之間的邊界。

深度學習如何助力圖像分割方法

現代圖像分割技術以深度學習技術為動力。

下面是幾種用于分割的深度學習架構:

使用CNN進行圖像分割,是將圖像的patch作為輸入輸入給卷積神經網絡,卷積神經網絡對像素進行標記。CNN不能一次處理整個圖像。它掃描圖像,每次看一個由幾個像素組成的小“濾鏡”,直到它映射出整個圖像。

傳統的cnn網絡具有全連接的層,不能處理不同的輸入大小。FCNs使用卷積層來處理不同大小的輸入,可以工作得更快。最終的輸出層具有較大的感受野,對應于圖像的高度和寬度,而通道的數量對應于類的數量。卷積層對每個像素進行分類,以確定圖像的上下文,包括目標的位置。

集成學習將兩個或兩個以上相關分析模型的結果合成為單個。集成學習可以提高預測精度,減少泛化誤差。這樣就可以對圖像進行精確的分類和分割。通過集成學習嘗試生成一組弱的基礎學習器,對圖像的部分進行分類,并組合它們的輸出,而不是試圖創建一個單一的最優學習者。

DeepLab使用DeepLab的一個主要動機是在幫助控制信號抽取的同時執行圖像分割 —— 減少樣本的數量和網絡必須處理的數據量。另一個動機是啟用多尺度上下文特征學習 —— 從不同尺度的圖像中聚合特征。DeepLab使用ImageNet預訓練的ResNet進行特征提取。DeepLab使用空洞卷積而不是規則的卷積。每個卷積的不同擴張率使ResNet塊能夠捕獲多尺度的上下文信息。

DeepLab由三個部分組成:

Atrous convolutions

使用一個因子,可以擴展或收縮卷積濾波器的視場。

ResNet微軟的深度卷積網絡(DCNN)。它提供了一個框架,可以在保持性能的同時訓練數千個層。ResNet強大的表征能力促進了計算機視覺應用的發展,如物體檢測和人臉識別。

Atrous spatial pyramid pooling (ASPP)提供多尺度信息。它使用一組具有不同擴展率的復雜函數來捕獲大范圍的上下文。ASPP還使用全局平均池(GAP)來合并圖像級特征并添加全局上下文信息。

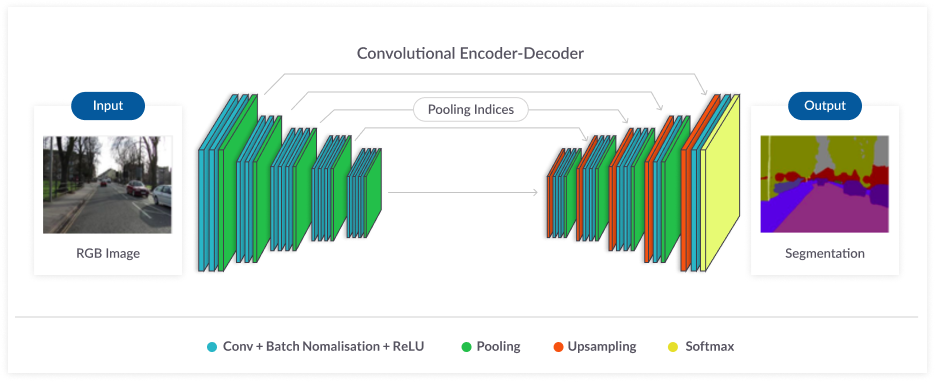

SegNet neural network 一種基于深度編碼器和解碼器的架構,也稱為語義像素分割。它包括對輸入圖像進行低維編碼,然后在解碼器中利用方向不變性能力恢復圖像。然后在解碼器端生成一個分割圖像。

圖像分割的應用

圖像分割有助于確定目標之間的關系,以及目標在圖像中的上下文。應用包括人臉識別、車牌識別和衛星圖像分析。例如,零售和時尚等行業在基于圖像的搜索中使用了圖像分割。自動駕駛汽車用它來了解周圍的環境。

目標檢測和人臉檢測

這些應用包括識別數字圖像中特定類的目標實例。語義對象可以分類成類,如人臉、汽車、建筑物或貓。

人臉檢測

一種用于許多應用的目標檢測,包括數字相機的生物識別和自動對焦功能。算法檢測和驗證面部特征的存在。例如,眼睛在灰度圖像中顯示為谷地。

醫學影像

從醫學影像中提取臨床相關信息。例如,放射學家可以使用機器學習來增強分析,通過將圖像分割成不同的器官、組織類型或疾病癥狀。這可以減少運行診斷測試所需的時間。

捕捉和處理圖像,為設備提供操作指導的應用。這包括工業和非工業的應用。機器視覺系統使用專用攝像機中的數字傳感器,使計算機硬件和軟件能夠測量、處理和分析圖像。例如,檢測系統為汽水瓶拍照,然后根據合格 - 不合格標準分析圖像,以確定瓶子是否被正確地填充。

視頻監控 — 視頻跟蹤和運動目標跟蹤

這涉及到在視頻中定位移動物體。其用途包括安全和監視、交通控制、人機交互和視頻編輯。

自動駕駛

自動駕駛汽車必須能夠感知和理解他們的環境,以便安全駕駛。相關類別的對象包括其他車輛、建筑物和行人。語義分割使自動駕駛汽車能夠識別圖像中的哪些區域可以安全駕駛。

虹膜識別

一種能識別復雜虹膜圖案的生物特征識別技術。它使用自動模式識別來分析人眼的視頻圖像。

人臉識別

從視頻中識別個體。這項技術將從輸入圖像中選擇的面部特征與數據庫中的人臉進行比較。

零售圖像識別

這個應用讓零售商了解貨架上商品的布局。算法實時處理產品數據,檢測貨架上是否有商品。如果有產品缺貨,他們可以找出原因,通知跟單員,并為供應鏈的相應部分推薦解決方案。

責任編輯:lq

-

圖像識別

+關注

關注

9文章

526瀏覽量

38955 -

圖像分割

+關注

關注

4文章

182瀏覽量

18277 -

深度學習

+關注

關注

73文章

5557瀏覽量

122576

原文標題:深度學習中的圖像分割:方法和應用

文章出處:【微信號:Imgtec,微信公眾號:Imagination Tech】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

圖像分割的方法,包括傳統方法和深度學習方法

圖像分割的方法,包括傳統方法和深度學習方法

評論