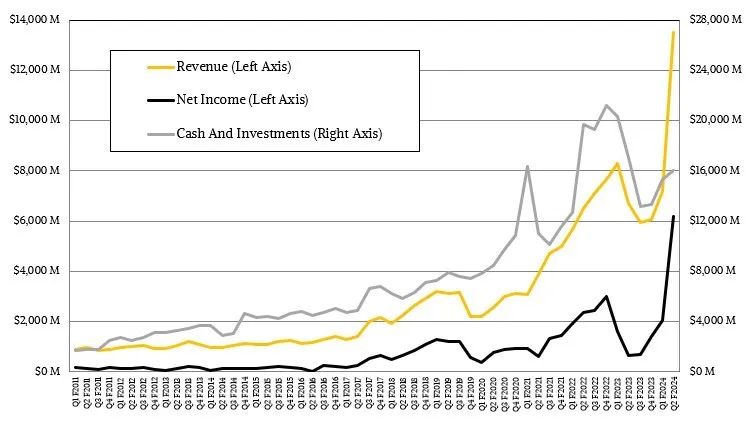

近日,英偉達公布了新一季度財報,在截至 7 月份的季度中,英偉達的收入同比增長了一倍多,達到 135.1 億美元,創下了公司的新紀錄,凈利潤增長了 9.4 倍,達到 61.9 億美元。英偉達預計第三財季收入將達到 160 億美元。

自去年11月ChatGPT上市后,人們對人工智能領域的興趣可以說達到了瘋狂的程度,震動范圍遠遠超出了科技行業。ChatGPT 使用 10,000 個英偉達圖形處理單元 (GPU) 進行訓練。CB Insights最近的一份報告指出,英偉達占據了機器學習 GPU 市場約 95% 的份額。

“一個新的計算時代已經開始。全球企業正在從通用計算向生成式人工智能轉型,”英偉達首席執行官黃仁勛表示。

英偉達已然主導人工智能芯片市場。

TechInsights 分析師Dan Hutcheson補充道:“英偉達之于人工智能幾乎就像英特爾之于個人電腦一樣。”

英偉達在AI硬件方面的地位“近乎壟斷”。英偉達目前最受歡迎的 AI 硬件產品包括A100和H100數據中心GPU,英偉達還將 H100 和 CPU 組合成一個名為GH200“Grace Hopper”芯片組的封裝,為英偉達的計算機系統系列提供動力。

英偉達的市場主導地位使得AMD等競爭對手競相追趕。但目前,英偉達的領先地位幾乎不可撼動。5月,英偉達成為第一家市值突破萬億美元的芯片公司。

“各行業和客戶對我們人工智能數據中心平臺的需求巨大且廣泛。”英偉達首席財務官Colette Kress在公司財報電話會議上談到。

02 GPU 短缺帶來的地位危機

然而,盡管英偉達的主導地位目前看起來已經確定,但長期來看卻很難預測。TIRIAS Research 的另一位行業分析師Kevin Krewell表示:“英偉達現在是每個人都想擊敗的目標。”

目前英偉達GPU短缺的問題愈演愈烈,短缺的主要原因在于行業需求的迅速增長與供應鏈的不足。人工智能的熱潮讓GPU的算力再度成為寶貴資源,云廠商們的算力儲備競賽愈發激烈。

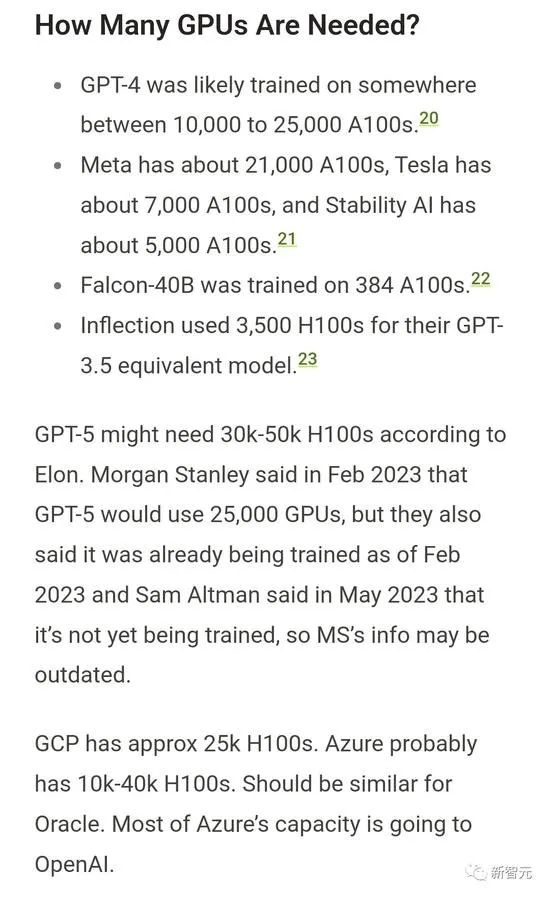

據了解:

GPT-4可能在大約10000-25000張A100上進行訓練

Meta大約21000 A100

特斯拉大約7000 A100

Stability AI大約5000 A100

Falcon-40B大約384個A100

Inflection使用了3500個H100

另外,預計GPT-5可能需要30000-50000個H100。Inflection需要22000個,Meta需要 25000,大型云服務商可能需要30000(比如Azure、Cloud、AWS、)。

國內互聯網巨頭也加入了這場 GPU 儲備賽。據報道,百度、字節跳動、騰訊和阿里巴巴已共同訂購了價值10億美元的英偉達A800處理器,預計于今年交付。他們還購買了價值40億美元的GPU,這部分訂單將于2024年交付。

持續上漲的需求讓GPU的供應緊縮看不到任何要結束的跡象。

英國《金融時報》的一篇報道稱,英偉達H100 AI 處理器到2024年的產量至少需要增加兩倍,從今年的約 50 萬臺增加到150萬至 200 萬臺。雖然這對英偉達的盈利來說是個好消息,但對于市場需求來說可能還遠遠不夠,如果短缺繼續,一些公司不會有耐心等待英偉達,而是尋找替代架構。

03 其他廠商能否抓住機會?

持續的短缺意味著競爭對手的機會到來了。

最引人注目的例子之一是阿聯酋G42 Cloud,該公司利用Cerebras Systems 構建了 9 臺 AI 超級計算機,每臺計算機的成本僅為 1 億美元,能夠實現 36 exaflops 的稀疏FP16 性能。

Cerebras 的加速器與為英偉達的 HGX 和 DGX 系統提供動力的 GPU 有很大不同。Cerebra 的加速器不是將四個或八個 GPU 裝入機架式機箱中,而是采用餐盤大小的巨大硅片封裝了 850000 個內核和 40GB SRAM。該芯片制造商聲稱,只需 16 個此類加速器即可實現 1 exaflop 的稀疏 FP16 性能,而這需要超過 500 個英偉達H100。

對于其他等不及英偉達提高產能的企業來說,并不缺乏替代方案。

英特爾和AMD 都以制造中央處理器(CPU)而聞名,但他們也為人工智能應用制造專用 GPU(英特爾最近才加入競爭)。

據了解,亞馬遜正在使用英特爾的 Gaudi AI 訓練加速器來補充自己的定制 Trainium 芯片,目前還不清楚具體數量。與英偉達的 A100 相比,去年 5 月推出的英特爾 Gaudi2 處理器聲稱其性能大約是 A100 的兩倍,至少在 ResNet-50 圖像分類模型和 BERT 自然語言處理模型中是如此。英特爾還針對中國市場推出了該芯片的精簡版。英特爾預計將在明年某個時候推出更強大的處理器版本,預計稱為 Gaudi3,與 Nvidia 當前的 H100 競爭。

在 6 月份的數據中心和人工智能活動中,AMD詳細介紹了其 Instinct MI300X,該產品預計于今年年底開始發貨。Instinct MI300X將 192GB 高速 HBM3 內存和8個 CDNA 3 GPU 芯片封裝在一起。The Next Platform 估計該芯片將提供大約 3 petaflops 的 FP8 性能。雖然 MI300X 的性能只有 Nvidia H100 的 75%,但內存容量提高了 2.4 倍,這可以讓客戶使用更少的GPU來訓練他們的模型。

此外,谷歌擁有張量處理單元(TPU),不僅用于搜索結果,還用于某些機器學習任務,而亞馬遜則擁有用于訓練人工智能模型的定制芯片。據報道,微軟也在開發人工智能芯片,Meta也有自己的人工智能芯片項目。

因此,如果英偉達目前只能滿足人工智能芯片三分之一的需求,那么為什么其競爭對手不加緊填補這一空白并從中獲利呢?

不過僅目前來看,英偉達著名的平臺戰略和以軟件為中心的方法仍然非常難以被擊敗。

“雖然其他廠商也提供類似的芯片或系統,但英偉達已經建立了一個強大的生態系統,其中包括芯片、相關硬件以及針對其芯片和系統進行優化的完整穩定的軟件和開發系統,”分析師Jack Gold表示。

此外,英偉達在將新功能集成到其系統方面也非常靈活。其他人工智能芯片初創公司在軟件工具方面的投資不足,因此盡管他們創建的云計算平臺可能比英偉達的更快或更便宜,但他們在當前的編程體驗上并沒有相應的改進。

對于擁有強大資源,致力于開發、優化或將遺留代碼移植到更新的架構的大型企業來說,選擇替代的硬件平臺可能能夠節省潛在的成本或縮短交付時間。谷歌和亞馬遜已經分別通過 TPU 和 Trainium 加速器走上了這條道路。

但對于缺乏這些資源的企業來說,在沒有經過驗證的軟件堆棧的情況下采用基礎設施,無論它的性能如何,都可能被視為一種負擔。在這種情況下,英偉達仍然是安全的選擇。

-

數據中心

+關注

關注

16文章

5216瀏覽量

73450 -

人工智能

+關注

關注

1806文章

48984瀏覽量

248922 -

英偉達

+關注

關注

22文章

3942瀏覽量

93564

原文標題:英偉達Q2利潤增長9.4倍,數據中心供應鏈短缺遭“踢館候補”

文章出處:【微信號:SDNLAB,微信公眾號:SDNLAB】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

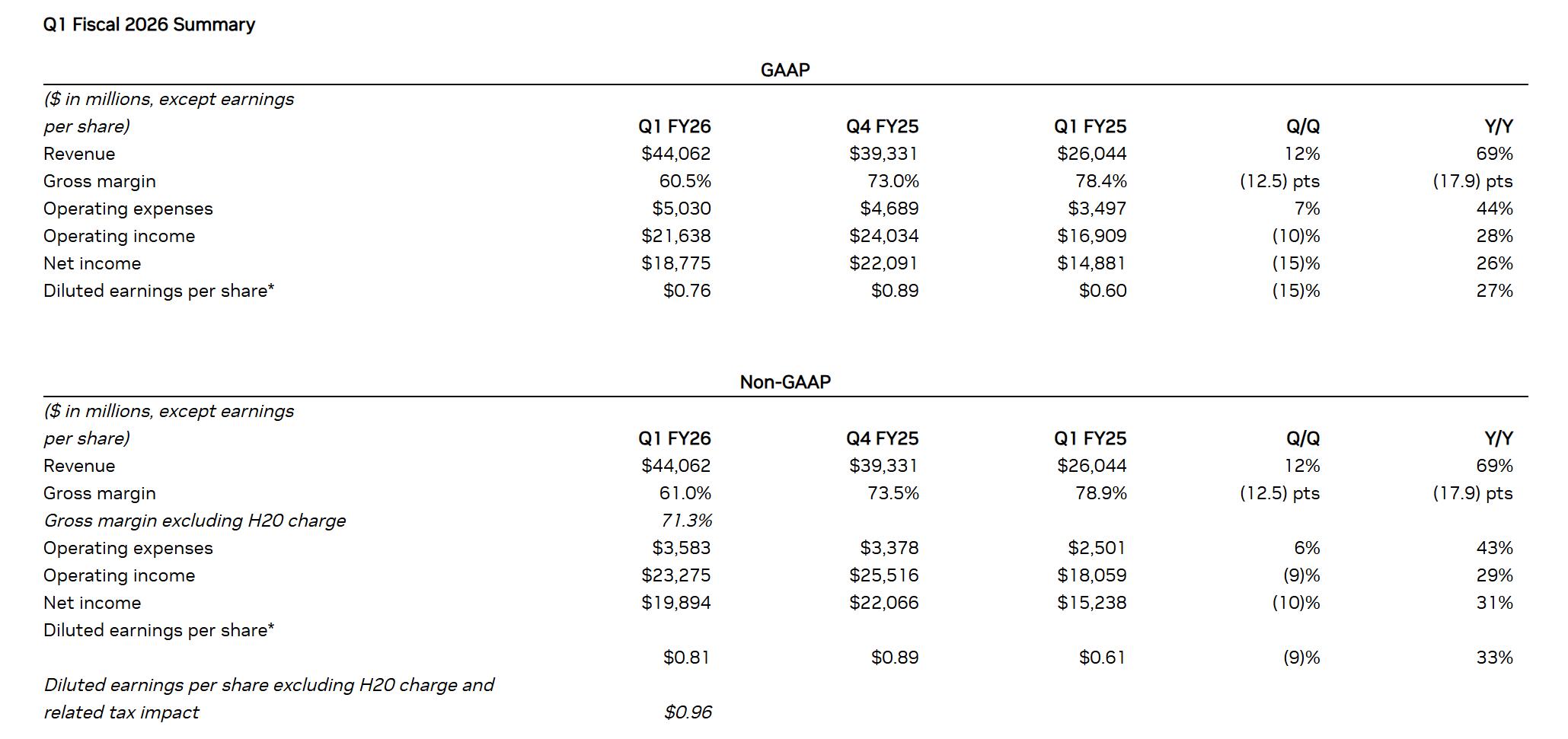

AI推理需求井噴!英偉達Q1營收大漲,H20禁售難擋增長步伐

英偉達單季營收破300億美元!Q2全球半導體Top15,幾家歡喜幾家愁?

看點:三星電子Q2利潤預計重挫39% 星動紀元宣布完成近5億元A輪融資

英偉達2026財年Q1營收公布 一季度營收441億美元 英偉達Q1凈利潤187.8億美元

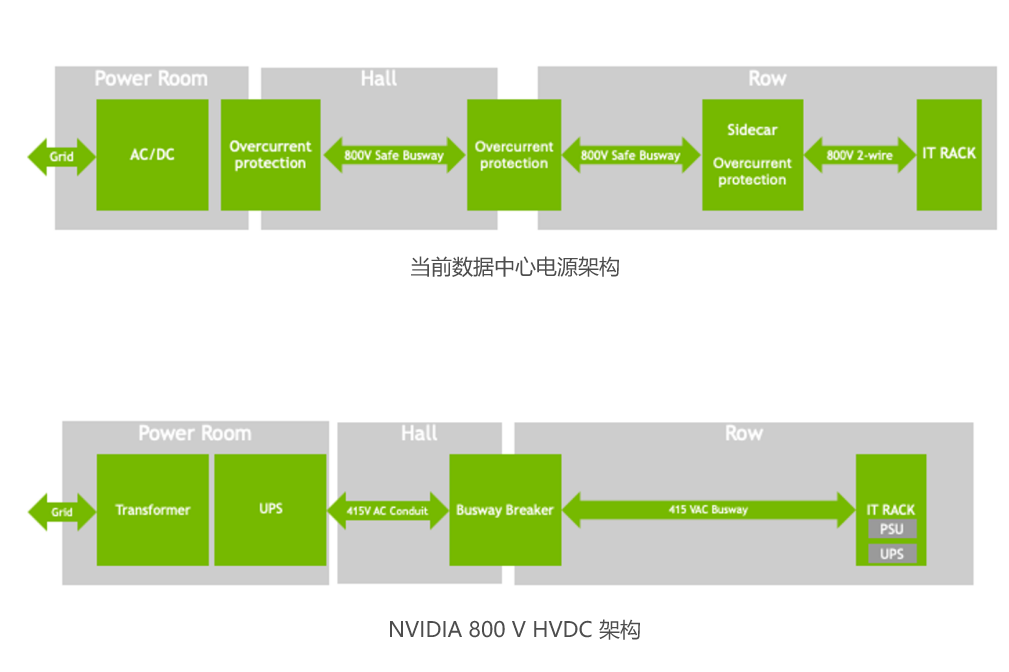

數據中心電力架構革命!英偉達強推800V HVDC,2年后量產

英偉達Q2利潤增長9.4倍,數據中心供應鏈短缺遭“踢館候補”

英偉達Q2利潤增長9.4倍,數據中心供應鏈短缺遭“踢館候補”

評論