先后和 OpenAI、Meta 牽手推動大模型發展的微軟,也正在加快自家小模型的迭代。就在今天,微軟正式發布了一個 27 億參數的語言模型——Phi-2。這是一種文本到文本的人工智能程序,具有出色的推理和語言理解能力。

同時,微軟研究院也在官方 X 平臺上如是說道,“Phi-2 的性能優于其他現有的小型語言模型,但它足夠小,可以在筆記本電腦或者移動設備上運行”。

Phi-2 的性能真能優于大它 25 倍的模型?

對于Phi-2 的發布,微軟研究院在官方公告的伊始便直言,Phi-2 的性能可與大它 25 倍的模型相匹配或優于。

這也讓人有些尷尬的事,不少網友評價道,這豈不是直接把 Google 剛發的 Gemini 最小型號的版本給輕松超越了?

那具體情況到底如何?

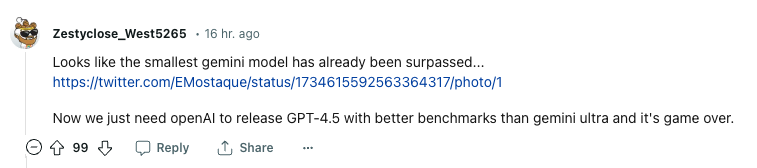

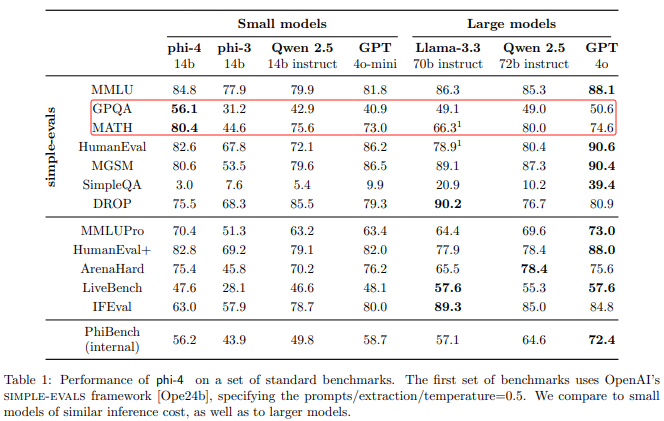

微軟通過時下一些如 Big Bench Hard (BBH)、常識推理(PIQA、WinoGrande、ARC easy 和 Challenge、SIQA)、語言理解(HellaSwag、OpenBookQA、MMLU(5-shot)、 SQuADv2、BoolQ)、數學(GSM8k)和編碼(HumanEval)等基準測試,將 Phi-2 與 7B 和 13B 參數的 Mistral 和 Llama-2 進行了比較。

最終得出僅擁有 27 億個參數的 Phi-2 ,超越了 Mistral 7B 和 Llama-2 7B 以及 13B 模型的性能。值得注意的是,與大它 25 倍的 Llama-2-70B 模型相比,Phi-2 還在多步推理任務(即編碼和數學)上實現了更好的性能。

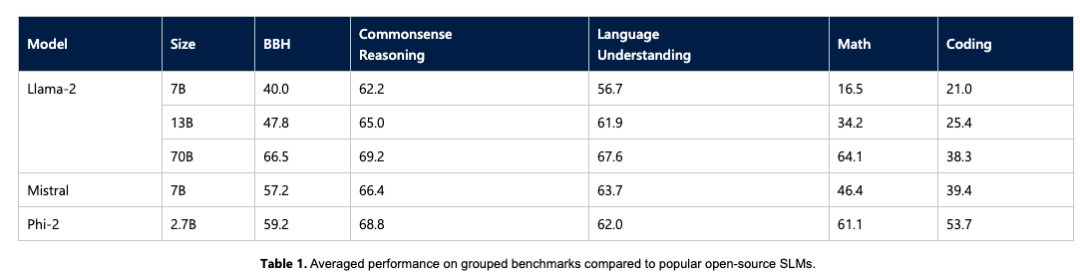

此外,如上文所提及的,微軟研究人員也直接在基準測試中放上了其與Google 全新發布的 Gemini Nano 2 正面PK 的結果,不出所料,Phi-2盡管尺寸較小,但性能還是把Gemini Nano 2 超了。

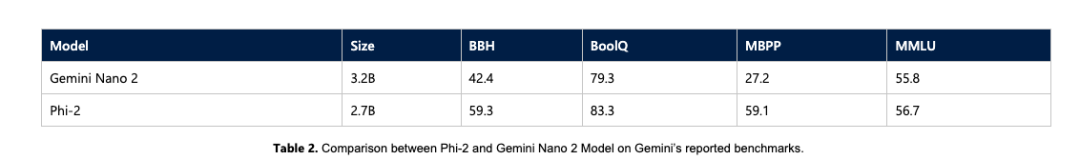

除了這些基準之外,研究人員似是在暗諷 Google 前幾日在Gemini 演示視頻中造假一事,因為當時 Google 稱其即將推出的最大、最強大的新人工智能模型 Gemini Ultra 能夠解決相當復雜的物理問題,并且甚至糾正學生的錯誤。

事實證明,盡管 Phi-2 的大小可能只是 Gemini Ultra 的一小部分,但它也能夠正確回答問題并使用相同的提示糾正學生。

微軟的改進

Phi-2 小模型之所以有如此亮眼的成績,微軟研究院在博客中解釋了原因。

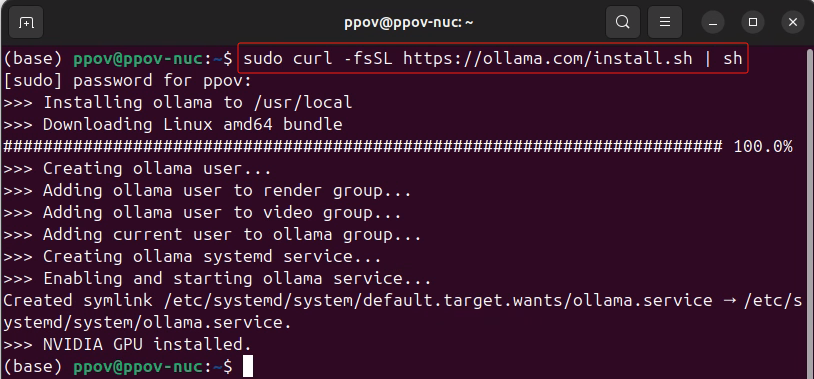

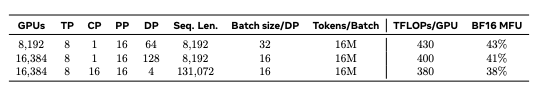

一是提升訓練數據的質量。Phi-2 是一個基于 Transformer 的模型,其目標是預測下一個單詞,它在 1.4T 個詞組上進行了訓練,這些詞組來自 NLP 和編碼的合成數據集和網絡數據集,包括科學、日常活動和心理理論等用于教授模型常識和推理的內容。Phi-2 的訓練是在 96 個 A100 GPU 上耗時 14 天完成的。

其次,微軟使用創新技術進行擴展,將其知識嵌入到 27 億參數 Phi-2 中。

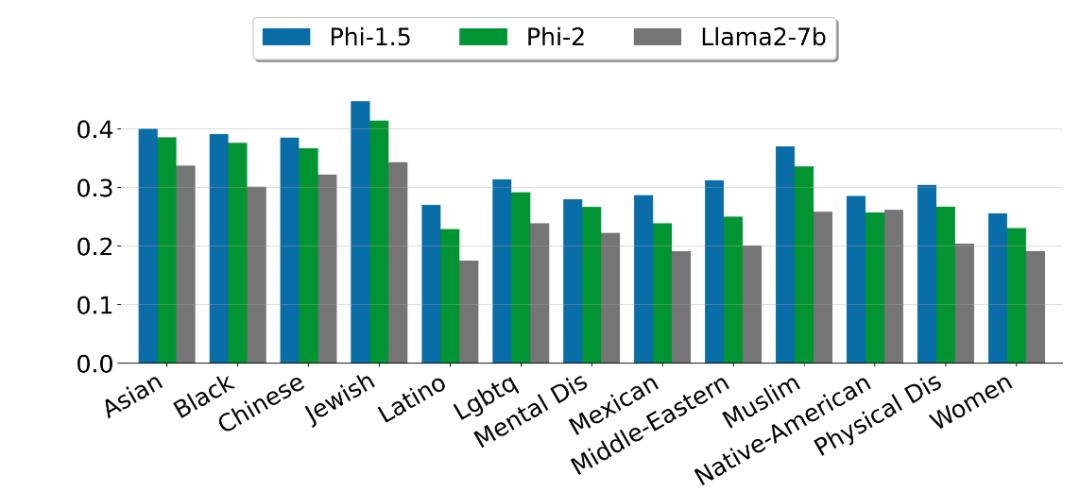

微軟指出,Phi-2 是一個基礎模型,沒有通過人類反饋強化學習(RLHF)進行調整,也沒有經過指導性微調。盡管如此,與經過對齊的現有開源模型相比,微軟觀察到在毒性和偏差方面,Phi-2 有更好的表現。

寫在最后

話說 Phi-2 的發布的確在小模型的性能上實現了突破,不過也有媒體發現它還存在很大的局限性。

因為根據微軟研究許可證顯示,其規定了 Phi -2 只能用于“非商業、非創收、研究目的”,而不是商業用途。因此,想要在其之上構建產品的企業就不走運了。

審核編輯:劉清

-

編碼器

+關注

關注

45文章

3786瀏覽量

137629 -

OpenAI

+關注

關注

9文章

1204瀏覽量

8757 -

大模型

+關注

關注

2文章

3087瀏覽量

3979

原文標題:只有 27 億參數,微軟發布全新 Phi-2 模型!

文章出處:【微信號:AI科技大本營,微信公眾號:AI科技大本營】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

小身板大能量:樹莓派玩轉 Phi-2、Mistral 和 LLaVA 等AI大模型~

微軟正式發布一個27億參數的語言模型—Phi-2

微軟正式發布一個27億參數的語言模型—Phi-2

評論