在開源開發(fā)者圈子來看,2023 年是大模型 LLM 年、生成式 AI GenAI 年,LLM 領(lǐng)域大放異彩。

LLM 是利用深度學(xué)習(xí)和大數(shù)據(jù)訓(xùn)練的人工智能系統(tǒng),專門設(shè)計(jì)來理解、生成和回應(yīng)自然語言。這些模型通過分析大量的文本數(shù)據(jù)來學(xué)習(xí)語言的結(jié)構(gòu)和用法,從而能夠執(zhí)行各種語言相關(guān)任務(wù)。

本篇將為大家介紹一下 LLM 相關(guān)的工具和平臺。

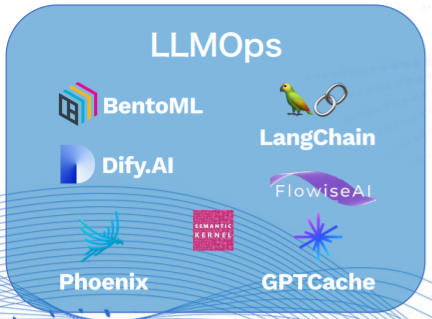

LLMOps

LLMOps 平臺專注于提供大模型的部署、運(yùn)維和優(yōu)化服務(wù),旨在幫助企業(yè)和開發(fā)者更高效地管理和使用這些先進(jìn)的 AI 模型,快速完成從模型到應(yīng)用的跨越,如 Dify.AI 、LangChain等。

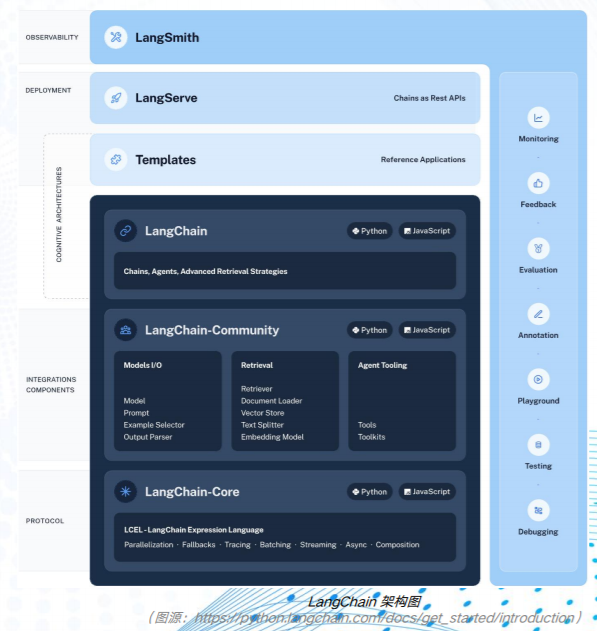

開源框架 LangChain 是一個幫助開發(fā)者使用 LLM 創(chuàng)建應(yīng)用的開源框架,它可以將 LLM 與外部數(shù)據(jù)源進(jìn)行連接,并允許與 LLM進(jìn)行交互。LangChain 于 2022 年 10 月作為開源項(xiàng)目推出,并于2023 年 4 月注冊成立公司,累計(jì)獲得超過 3000 萬美元的投資,估值達(dá)到了 2 億美元。在 GitHub 上,LangChain 已經(jīng)獲得了超過 7 萬個 Star 和超過 2000 名貢獻(xiàn)者。

大模型聚合平臺

大模型聚合平臺主要用于整合和管理多個大型機(jī)器學(xué)習(xí)模型,在聚合平臺之上,衍生出 MaaS(Model-as-a- Service,大模型即服務(wù))的服務(wù)模式——通過提供統(tǒng)一的接口和框架,以更高效地部署、運(yùn)行和優(yōu)化這些模型,Hugging Face、Replicate 以及 Gitee AI 均為 MaaS 平臺。

Gitee AI 是開源中國旗下的 MaaS 平臺,提供模型、數(shù)據(jù)集,以及應(yīng)用托管能力,同時接入了豐富的國產(chǎn)算力平臺,為開發(fā)者提供了更高效、實(shí)惠的微調(diào)方案,降低使用門檻,目前已進(jìn)入內(nèi)測階段。

開發(fā)工具

其它開發(fā)相關(guān)的 LLM 工具,如云原生構(gòu)建多模態(tài)AI應(yīng)用的工具 Jina,嵌入式數(shù)據(jù)庫 txtai 等。

比較有代表性的 LLM 開發(fā)工具有:

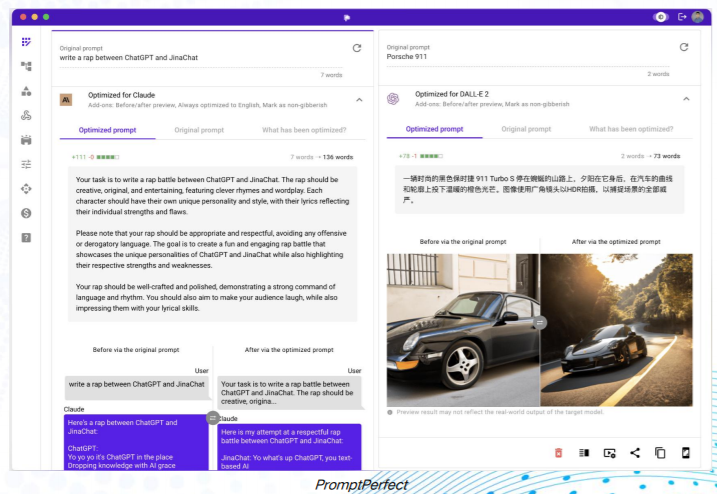

PromptPerfect:幫助用戶極致優(yōu)化給大模型的提示詞(prompt),使得對大語言模型提問時,可以獲得更理想的輸出。

txtai:用于語義搜索、LLM 編排和語言模型工作流的一體化嵌入數(shù)據(jù)庫,可以使用SQL、對象存儲、主題建模、圖形分析和多模態(tài)索引進(jìn)行矢量搜索。

imgcook:專注以 Sketch、PSD、靜態(tài)圖片等形式的視覺稿作為輸入,通過智能化技術(shù)一鍵生成可維護(hù)的前端代碼,包含視圖代碼、數(shù)據(jù)字段綁定、組件代碼、部分業(yè)務(wù)邏輯代碼。

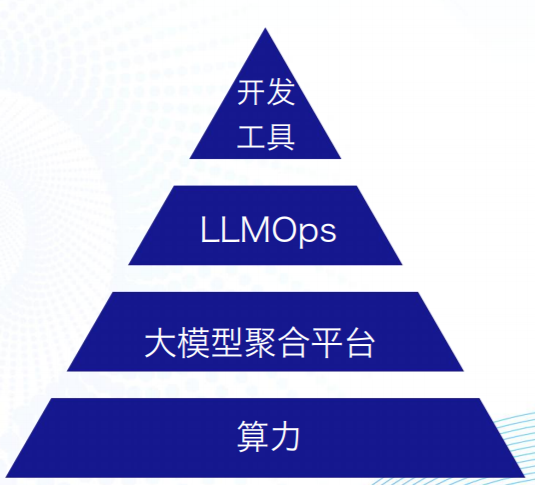

另一個視角來看,在大模型繁榮發(fā)展的背后,少不了工具和平臺的發(fā)力,如 LLMOps 平臺、大模型聚合平臺以及相關(guān)的開發(fā)工具,此外還有它們所依賴的最重要的資源——算力。在這些工具、平臺和資源的有力支撐下,大模型才得以一步一個臺階,引領(lǐng)全球開發(fā)者步入一個技術(shù)新時代。

以上內(nèi)容出自《2023 LLM 技術(shù)報告》,此報告濃墨重彩地梳理了 2023 年 LLM 的技術(shù)行情。報告整體圍繞 LLM Tech Map 梳理邏輯來展開,從基礎(chǔ)設(shè)施、大模型、Agent、AI 編程、工具和平臺,以及算力幾個方面,為開發(fā)者整理了當(dāng)前 LLM 中最為熱門和硬核的技術(shù)領(lǐng)域以及相關(guān)的軟件產(chǎn)品和開源項(xiàng)目。

-

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5561瀏覽量

122784 -

大模型

+關(guān)注

關(guān)注

2文章

3138瀏覽量

4059 -

LLM

+關(guān)注

關(guān)注

1文章

325瀏覽量

835

原文標(biāo)題:2023 LLM技術(shù)報告—— LLM的工具和平臺

文章出處:【微信號:OSC開源社區(qū),微信公眾號:OSC開源社區(qū)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

如何在魔搭社區(qū)使用TensorRT-LLM加速優(yōu)化Qwen3系列模型推理部署

使用 llm-agent-rag-llamaindex 筆記本時收到的 NPU 錯誤怎么解決?

LM Studio使用NVIDIA技術(shù)加速LLM性能

詳解 LLM 推理模型的現(xiàn)狀

無法在OVMS上運(yùn)行來自Meta的大型語言模型 (LLM),為什么?

新品| LLM630 Compute Kit,AI 大語言模型推理開發(fā)平臺

小白學(xué)大模型:構(gòu)建LLM的關(guān)鍵步驟

2023 LLM技術(shù)報告—— LLM的工具和平臺

2023 LLM技術(shù)報告—— LLM的工具和平臺

評論