Aux-Think,把推理當(dāng)作訓(xùn)練時(shí)的助力,而非測(cè)試時(shí)的負(fù)擔(dān),打破視覺(jué)語(yǔ)言導(dǎo)航任務(wù)的常規(guī)推理范式

視覺(jué)語(yǔ)言導(dǎo)航(VLN)任務(wù)的核心挑戰(zhàn),是讓機(jī)器人在復(fù)雜環(huán)境中聽(tīng)懂指令、看懂世界,并果斷行動(dòng)。我們系統(tǒng)性地引入推理任務(wù),探索其在導(dǎo)航策略學(xué)習(xí)中的作用,并首次揭示了VLN中的“推理崩塌”現(xiàn)象。研究發(fā)現(xiàn):無(wú)論是行動(dòng)前推理(Pre-Think),還是行動(dòng)后推理(Post-Think),一旦在測(cè)試階段顯式生成推理鏈,反而更容易讓機(jī)器人迷失方向。

Aux-Think提出一種更實(shí)用的路徑:在訓(xùn)練階段引入推理任務(wù)作為輔助監(jiān)督,引導(dǎo)模型習(xí)得更清晰的決策邏輯;而在測(cè)試階段,則徹底省去推理生成,直接進(jìn)行動(dòng)作預(yù)測(cè)。把推理用在該用的地方,模型在任務(wù)中反而更穩(wěn)、更準(zhǔn)、更省。Aux-Think不僅有效避免了測(cè)試階段的推理幻覺(jué),也為“推理應(yīng)在何時(shí)、如何使用”提供了清晰答案,進(jìn)一步拓展了數(shù)據(jù)高效導(dǎo)航模型的能力邊界。

? 論文題目:

Aux-Think: Exploring Reasoning Strategies for Data-Efficient Vision-Language Navigation

? 論文鏈接:

https://arxiv.org/abs/2505.11886

?項(xiàng)目主頁(yè):

https://horizonrobotics.github.io/robot_lab/aux-think/

視覺(jué)語(yǔ)言導(dǎo)航 (VLN) 的推理策略

在視覺(jué)語(yǔ)言導(dǎo)航 (VLN) 任務(wù)中,機(jī)器人需要根據(jù)自然語(yǔ)言指令在復(fù)雜環(huán)境中做出實(shí)時(shí)決策。雖然推理在許多任務(wù)中已有廣泛應(yīng)用,但在VLN任務(wù)中,推理的作用一直未被充分探討。我們是第一個(gè)系統(tǒng)性研究推理策略對(duì)VLN任務(wù)影響的團(tuán)隊(duì),發(fā)現(xiàn)現(xiàn)有的推理策略 (Pre-Think和Post-Think) 在測(cè)試階段反而導(dǎo)致了較差的表現(xiàn),讓機(jī)器人導(dǎo)航失敗。與此不同的是,我們提出的Aux-Think框架通過(guò)創(chuàng)新設(shè)計(jì)有效解決了這一問(wèn)題。

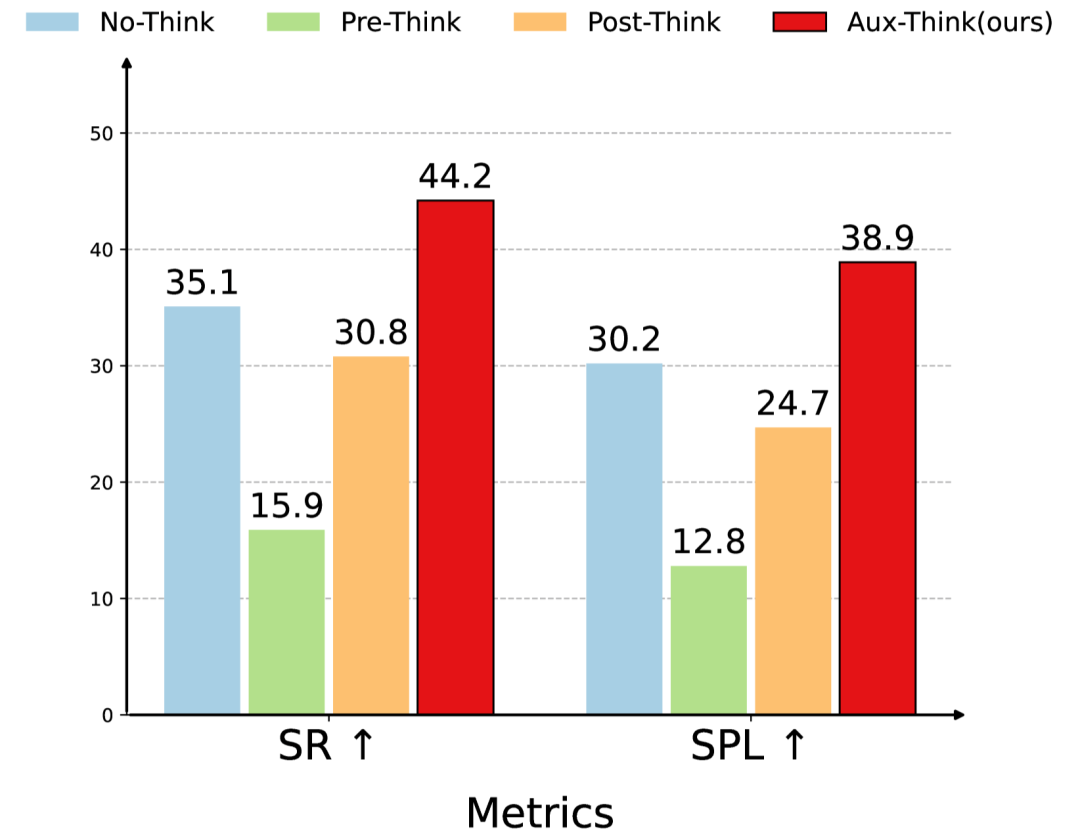

Aux-Think優(yōu)于Pre-Think和Post-Think其它推理策略

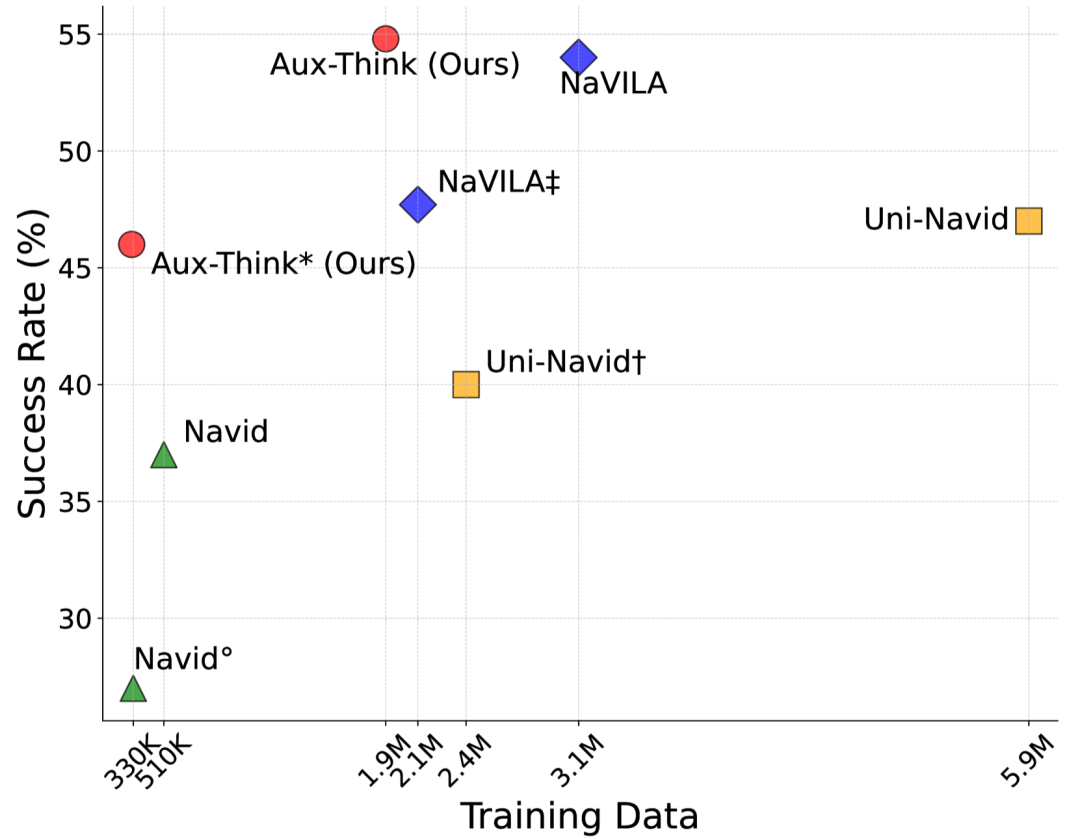

Aux-Think在數(shù)據(jù)效率與成功率之間達(dá)到帕累托最優(yōu)

測(cè)試階段推理的挑戰(zhàn)

想象一名司機(jī)在開(kāi)車(chē)時(shí)不斷分析路況,并頻繁回顧交通規(guī)則后才做決策。雖然這有助于理解環(huán)境,但當(dāng)遇到陌生或復(fù)雜情況時(shí),這種“思考過(guò)度”的方式反而容易因推理偏差而判斷失誤。

在視覺(jué)語(yǔ)言導(dǎo)航任務(wù)中,推理就像回顧交通規(guī)則,決策則對(duì)應(yīng)真實(shí)的駕駛操作。推理本意是為了幫助機(jī)器人理解任務(wù),但一旦進(jìn)入訓(xùn)練中未見(jiàn)過(guò)的狀態(tài),思維鏈便可能產(chǎn)生幻覺(jué)。尤其是在不熟悉的環(huán)境中,過(guò)度依賴(lài)推理不僅無(wú)法提升決策,反而干擾行動(dòng)、累積誤差,最終導(dǎo)致機(jī)器人“誤入歧途”。這種“推理崩塌”現(xiàn)象正是Aux-Think希望解決的關(guān)鍵問(wèn)題。

Aux-Think給出的新答案

為了應(yīng)對(duì)上述問(wèn)題,我們提出了Aux-Think,一種全新的推理訓(xùn)練框架。Aux-Think的核心思想是:在訓(xùn)練階段通過(guò)推理指導(dǎo)模型的學(xué)習(xí),而在測(cè)試階段,機(jī)器人直接依賴(lài)訓(xùn)練過(guò)程中學(xué)到的知識(shí)進(jìn)行決策,不再進(jìn)行推理生成。具體來(lái)說(shuō),Aux-Think將推理和行動(dòng)分開(kāi)進(jìn)行:

訓(xùn)練階段:通過(guò)引導(dǎo)模型學(xué)習(xí)推理任務(wù),幫助其內(nèi)化推理模式。

測(cè)試階段:直接根據(jù)訓(xùn)練中學(xué)到的決策知識(shí)進(jìn)行行動(dòng)預(yù)測(cè),不再進(jìn)行額外的推理生成。

這種設(shè)計(jì)有效避免了測(cè)試階段推理帶來(lái)的錯(cuò)誤和不穩(wěn)定性,確保機(jī)器人能更加專(zhuān)注于執(zhí)行任務(wù),減少了推理過(guò)程中可能引入的負(fù)面影響。

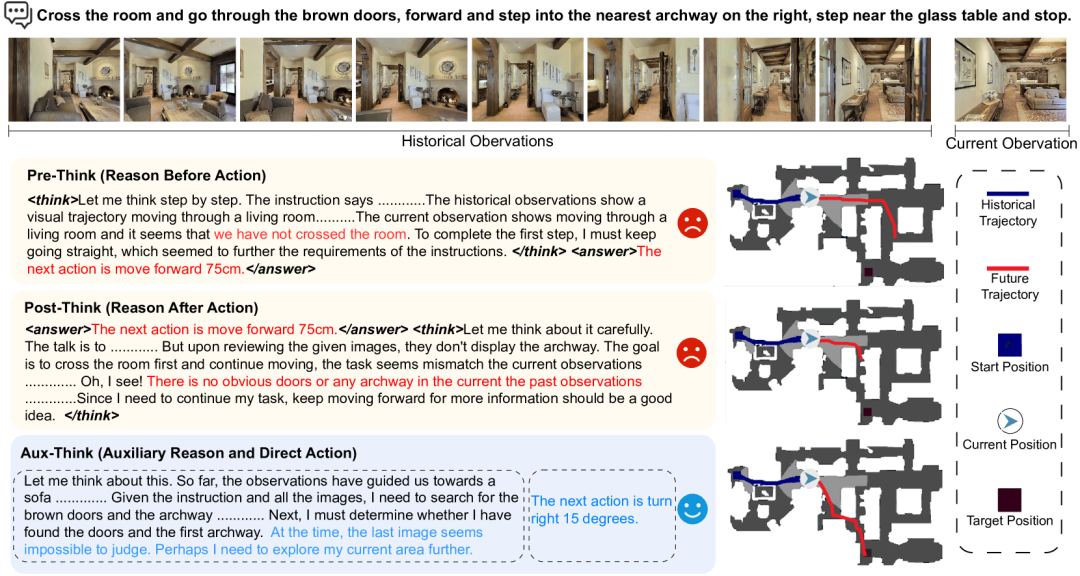

上圖中展示的是一個(gè)導(dǎo)航任務(wù):“穿過(guò)房間,走到右側(cè)的拱門(mén)并停在玻璃桌旁”。三種策略面對(duì)相同場(chǎng)景做出了不同反應(yīng):Pre-Think模型在行動(dòng)前試圖推理整條路徑,認(rèn)為應(yīng)該“前進(jìn)75cm”,但忽視了當(dāng)前觀(guān)察并未穿過(guò)房間,導(dǎo)致偏離目標(biāo);Post-Think模型在執(zhí)行動(dòng)作后才分析環(huán)境,發(fā)現(xiàn)沒(méi)有看到拱門(mén),但錯(cuò)誤已發(fā)生,只能繼續(xù)試探,繼續(xù)偏航;Aux-Think則在訓(xùn)練時(shí)學(xué)習(xí)推理邏輯,測(cè)試時(shí)直接基于當(dāng)前觀(guān)察判斷“右轉(zhuǎn)15度”,準(zhǔn)確識(shí)別拱門(mén)位置,成功完成導(dǎo)航任務(wù)。

實(shí)驗(yàn)結(jié)果

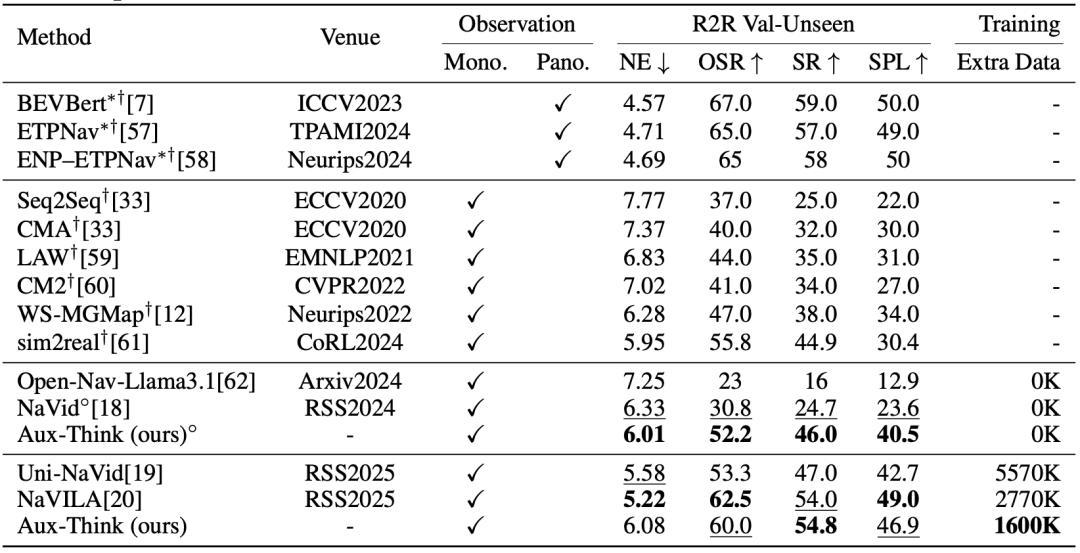

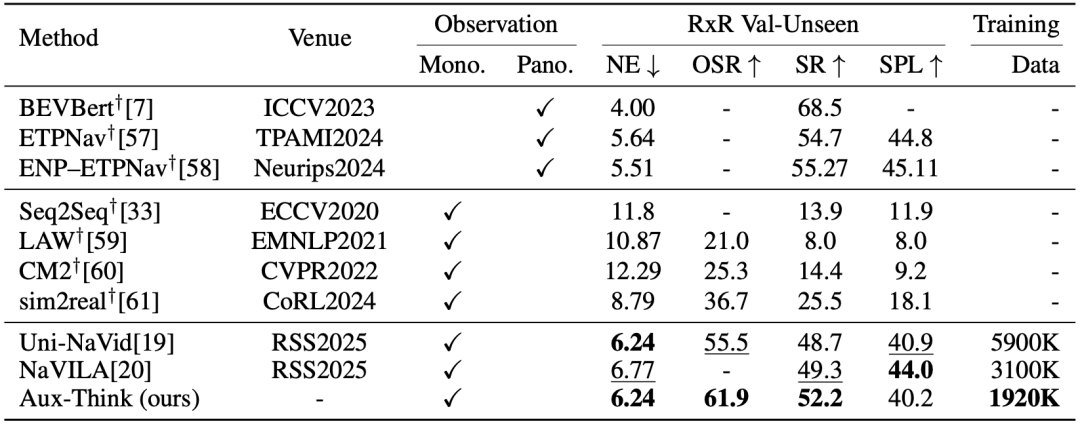

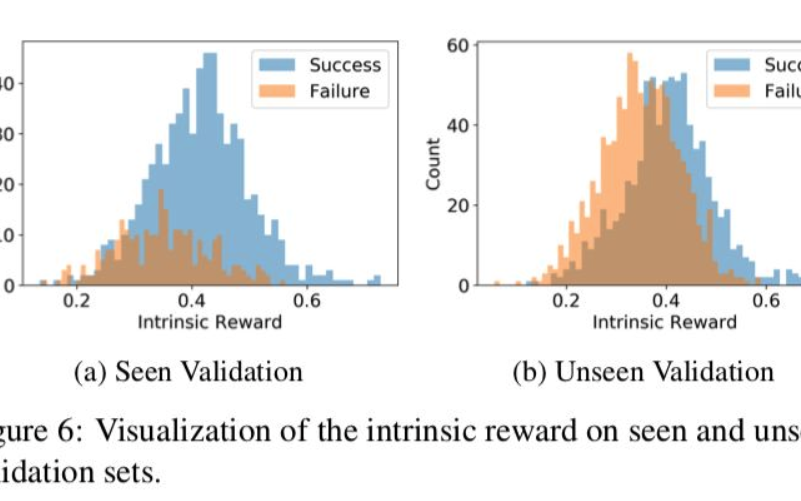

大量實(shí)驗(yàn)表明,Aux-Think在數(shù)據(jù)效率與導(dǎo)航表現(xiàn)方面優(yōu)于當(dāng)前領(lǐng)先方法。盡管訓(xùn)練數(shù)據(jù)較少,Aux-Think仍在多個(gè)VLN基準(zhǔn)上取得了單目 (Monocular) 方法中的最高成功率。通過(guò)僅在訓(xùn)練階段內(nèi)化推理能力,Aux-Think有效緩解了測(cè)試階段的推理幻覺(jué)與錯(cuò)誤傳播,在動(dòng)態(tài)、長(zhǎng)程導(dǎo)航任務(wù)中展現(xiàn)出更強(qiáng)的泛化能力與穩(wěn)定性。

R2R-CE上的指標(biāo):Aux-Think在視覺(jué)語(yǔ)言導(dǎo)航任務(wù)的R2R驗(yàn)證集 (Val-Unseen) 上取得領(lǐng)先的成功率 (SR) ,即使使用的訓(xùn)練數(shù)據(jù)更少,也能超越多種現(xiàn)有方法。

RxR-CE上的指標(biāo):RxR比R2R更大、更復(fù)雜,Aux-Think在RxR驗(yàn)證集上依然以更少數(shù)據(jù)實(shí)現(xiàn)更高成功率 (SR) ,展現(xiàn)出優(yōu)越的泛化能力。

總結(jié)與展望

Aux-Think為解決測(cè)試階段推理引發(fā)的導(dǎo)航問(wèn)題提供了新的思路。通過(guò)在訓(xùn)練階段引入推理指導(dǎo),在測(cè)試階段去除推理負(fù)擔(dān),Aux-Think能夠讓機(jī)器人更加專(zhuān)注于任務(wù)執(zhí)行,從而提高其導(dǎo)航穩(wěn)定性和準(zhǔn)確性。這一突破性進(jìn)展將為機(jī)器人在實(shí)際應(yīng)用中的表現(xiàn)奠定更為堅(jiān)實(shí)的基礎(chǔ),也為具身推理策略提供了重要啟示。

.

-

機(jī)器人

+關(guān)注

關(guān)注

213文章

29681瀏覽量

212555 -

導(dǎo)航

+關(guān)注

關(guān)注

7文章

553瀏覽量

43121

原文標(biāo)題:開(kāi)發(fā)者說(shuō)|Aux-Think:為什么測(cè)試時(shí)推理反而讓機(jī)器人「誤入歧途」?

文章出處:【微信號(hào):horizonrobotics,微信公眾號(hào):地平線(xiàn)HorizonRobotics】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

大型語(yǔ)言模型的邏輯推理能力探究

一種在視覺(jué)語(yǔ)言導(dǎo)航任務(wù)中提出的新方法,來(lái)探索未知環(huán)境

各位高手,我想在汽車(chē)導(dǎo)航電路板上加一個(gè)aux輸出接口

基于計(jì)算機(jī)視覺(jué)和NLP的跨媒體問(wèn)答與推理

視覺(jué)問(wèn)答與對(duì)話(huà)任務(wù)研究綜述

ACL2021的跨視覺(jué)語(yǔ)言模態(tài)論文之跨視覺(jué)語(yǔ)言模態(tài)任務(wù)與方法

用于語(yǔ)言和視覺(jué)處理的高效 Transformer能在多種語(yǔ)言和視覺(jué)任務(wù)中帶來(lái)優(yōu)異效果

視覺(jué)語(yǔ)言導(dǎo)航領(lǐng)域任務(wù)、方法和未來(lái)方向的綜述

多維度剖析視覺(jué)-語(yǔ)言訓(xùn)練的技術(shù)路線(xiàn)

深度探討VLMs距離視覺(jué)演繹推理還有多遠(yuǎn)?

基于視覺(jué)語(yǔ)言模型的導(dǎo)航框架VLMnav

NaVILA:加州大學(xué)與英偉達(dá)聯(lián)合發(fā)布新型視覺(jué)語(yǔ)言模型

think-cell:與PowerPoint交換文件

新品| LLM630 Compute Kit,AI 大語(yǔ)言模型推理開(kāi)發(fā)平臺(tái)

Aux-Think打破視覺(jué)語(yǔ)言導(dǎo)航任務(wù)的常規(guī)推理范式

Aux-Think打破視覺(jué)語(yǔ)言導(dǎo)航任務(wù)的常規(guī)推理范式

評(píng)論