融入了Prompt的新模式大致可以歸納成”pre-train, prompt, and predict“,在該模式中,下游任務(wù)被重新調(diào)整成類似預(yù)訓(xùn)練任務(wù)的形式。例如,通常的預(yù)訓(xùn)練任務(wù)有Masked Language Model, 在文本情感分類任務(wù)中,對于 "I love this movie." 這句輸入,可以在后面加上prompt "The movie is ___" 這樣的形式,然后讓PLM用表示情感的答案填空如 "great"、"fantastic" 等等,最后再將該答案轉(zhuǎn)化成情感分類的標(biāo)簽,這樣以來,通過選取合適的prompt,我們可以控制模型預(yù)測輸出,從而一個完全無監(jiān)督訓(xùn)練的PLM可以被用來解決各種各樣的下游任務(wù)。

因此,合適的prompt對于模型的效果至關(guān)重要。大量研究表明,prompt的微小差別,可能會造成效果的巨大差異。研究者們就如何設(shè)計prompt做出了各種各樣的努力——自然語言背景知識的融合、自動生成prompt的搜索、不再拘泥于語言形式的prompt探索等等。

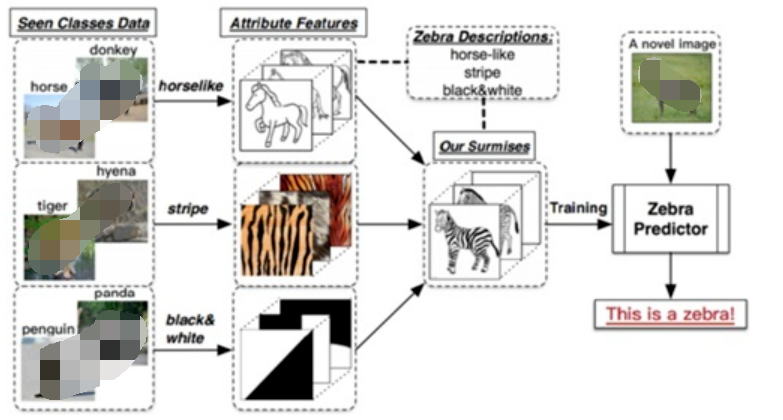

而對于視覺領(lǐng)域的prompt,最近在視覺語言預(yù)訓(xùn)練方面的進(jìn)展,如CLIP和ALIGN,prompt為開發(fā)視覺任務(wù)的基礎(chǔ)模型提供了一個有前途的方向。這些基礎(chǔ)模型在數(shù)百萬個有噪聲的圖像-文本對上進(jìn)行訓(xùn)練后編碼了廣泛的視覺概念,可以在不需要任務(wù)特定的訓(xùn)練數(shù)據(jù)的情況下以零目標(biāo)的方式應(yīng)用于下游任務(wù)。這可以通過適當(dāng)設(shè)計的prompt提示實(shí)現(xiàn)。

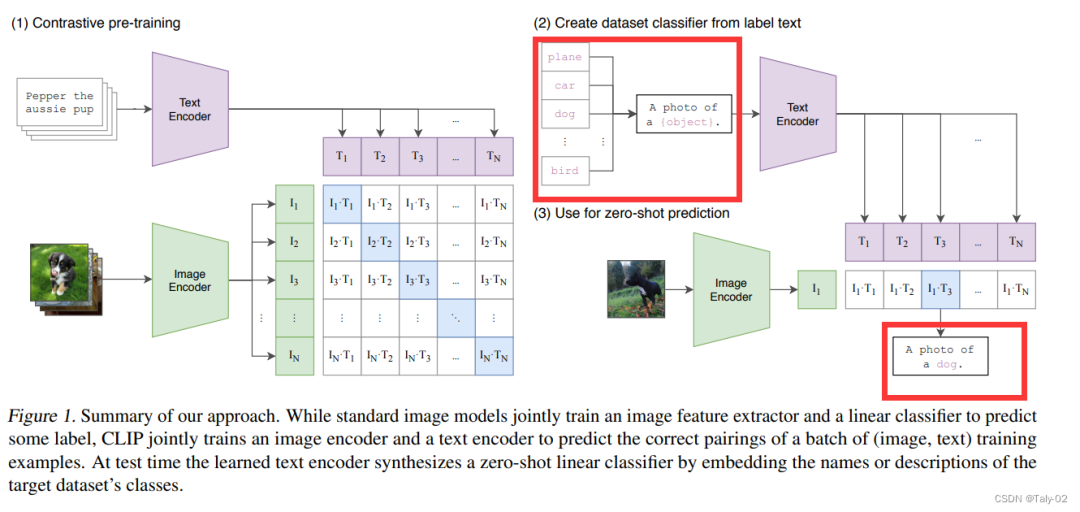

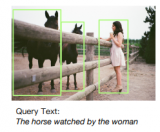

以CLIP為例,如下圖紅色方框強(qiáng)調(diào)所示,可以完成對“class label”的拓展,使得模型具有較為豐富的視覺信息。然后,可以使用CLIP對圖像進(jìn)行分類,以度量它們與各種類描述的對齊程度。因此,設(shè)計這樣的提示在以zero-shot方式將基礎(chǔ)模型應(yīng)用到下游任務(wù)中起著至關(guān)重要的作用。

然而,這種手工制作的prompt需要特定于領(lǐng)域的靈感,因此可能較難設(shè)計,所以如何設(shè)計一種模式,可以讓讓模型自適應(yīng)地學(xué)習(xí)到有關(guān)prompt的一些參數(shù)和設(shè)定是非常有必要的。與手工制作的prompt相比,這種方法可以找到更好的prompt,但學(xué)習(xí)到的prompt僅限于與訓(xùn)練數(shù)據(jù)對應(yīng)的分布和任務(wù),除此之外的泛化可能有限。

此外,這種方法需要帶注釋的訓(xùn)練數(shù)據(jù),這可能非常昂貴,而且不能很好地應(yīng)用于zero-shot的相關(guān)任務(wù)中。為了解決上述的挑戰(zhàn), 論文提出在測試階段使用test-time prompt tuning(TPT),只使用給定的測試樣本對prompt進(jìn)行調(diào)整。由于避免了使用額外的訓(xùn)練數(shù)據(jù)或標(biāo)注,TPT仍然遵守了zero-shot的設(shè)置。

. 方法

論文首先簡單回顧了CLIP和基于CLIP的一些可學(xué)習(xí)參數(shù)的prompts獲取方法。對于為何要優(yōu)化prompt,論文是這樣描述的:CLIP包含了豐富的知識,從前期的訓(xùn)練中獲得了海量的知識和不同的數(shù)據(jù)感知能力。然而,如何更有效地提取這些知識仍然是一個開放的問題。一個簡單的策略是直接對模型進(jìn)行微調(diào),無論是端到端的還是針對的一個子集層,對一類的輸入。然而,先前的工作表明,這種微調(diào)策略導(dǎo)致特定于領(lǐng)域的行為失去了非分布泛化和魯棒性的基礎(chǔ)模型。

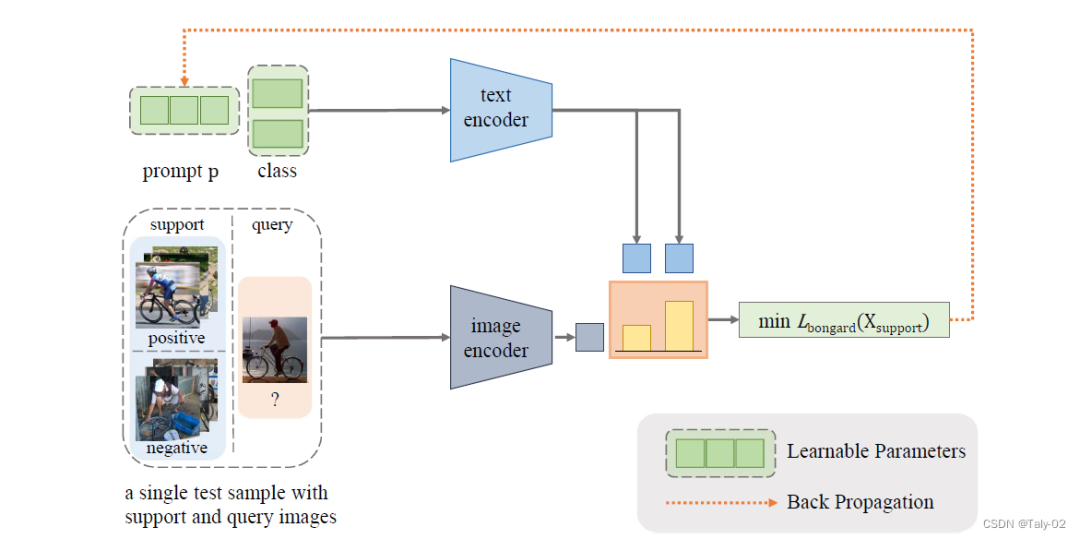

因此,這項(xiàng)工作的目標(biāo)是利用現(xiàn)有的CLIP知識來促進(jìn)其泛化到zero-shot的廠家中去。因此,調(diào)整prompt就是實(shí)現(xiàn)這一目標(biāo)的理想途徑。此外,我們將測試時提示調(diào)優(yōu)視為為模型提供上下文的一種方法為單個測試樣本量身定制,有助于精確檢索CLIP知識。

論文的目的很簡單,就是在測試階段得不到測試樣本ground-truth標(biāo)注的時候,進(jìn)行一定的訓(xùn)練,具體表現(xiàn)為

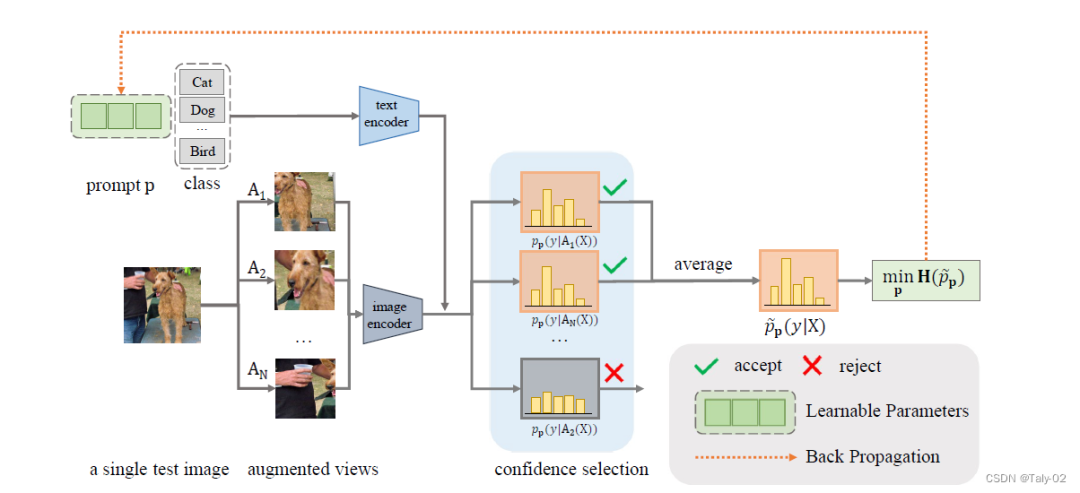

因?yàn)闃?biāo)簽不能用于測試階段的優(yōu)化,所以我們?nèi)绻朐跍y試階段進(jìn)行優(yōu)化就必須選擇用于能夠提供一定hint的無監(jiān)督損失函數(shù)來指導(dǎo)優(yōu)化。因此,論文設(shè)計了TPT目標(biāo)來促進(jìn)采用不同數(shù)據(jù)增強(qiáng)下,模型的一致性。通過對給定測試相同圖像的不同增強(qiáng)類型的特征,來依照他們預(yù)測的差值來進(jìn)行訓(xùn)練。具體來說,我們使用一個隨機(jī)增廣cluster生成測試圖像的N個隨機(jī)augumention視圖,最小化平均預(yù)測概率分布的熵:

這里 是根據(jù)物體不同prompt and the -th augmented view of the test image預(yù)測出的概率。

值得一提的是,為了減少隨機(jī)增強(qiáng)的噪聲(也就是說增強(qiáng)之后模型很難再預(yù)測出正確的分類信息,如刪去了圖像非常關(guān)鍵的content),本文還引入了一個新的機(jī)制:confidence selection,來選擇過濾增強(qiáng)產(chǎn)生的低置信度預(yù)測的view。數(shù)學(xué)表達(dá)式體現(xiàn)為:

實(shí)驗(yàn)

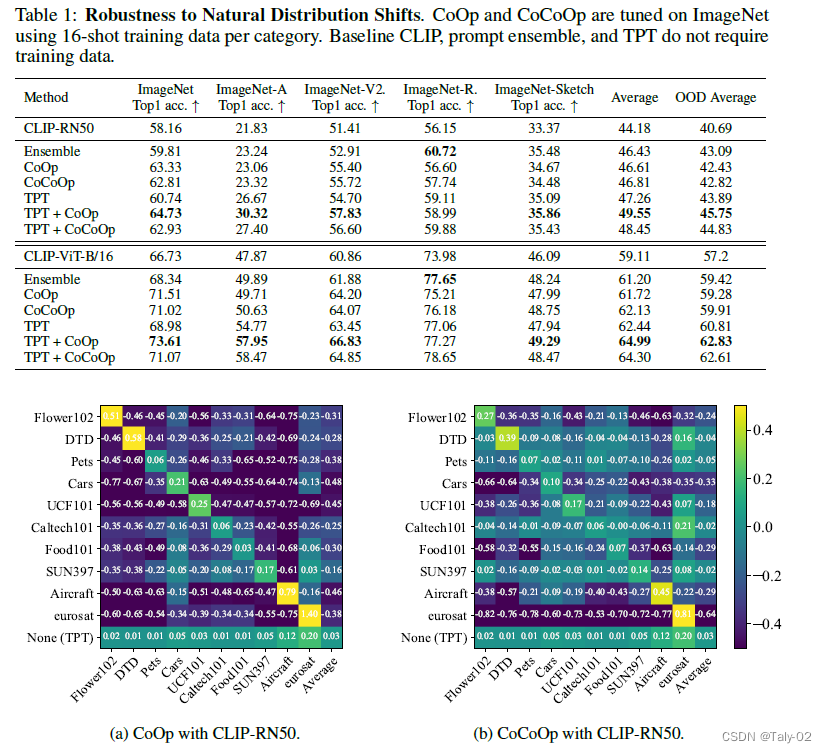

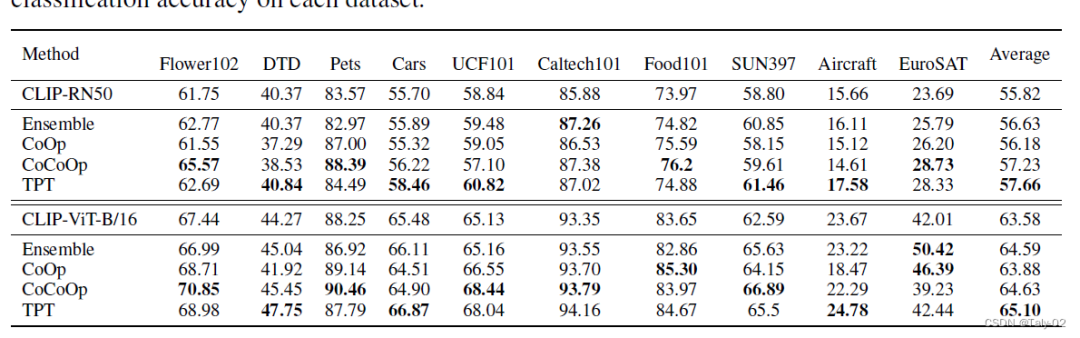

首先論文根據(jù)CoOp 和 CoCoOp的混淆矩陣可視化來判斷這兩種可學(xué)習(xí)的prompt參數(shù)化方式在不同數(shù)據(jù)集上的遷移性很差,有增加參數(shù)量過擬合的嫌疑。所以其實(shí)在訓(xùn)練階段,增加參數(shù)量來做相應(yīng)的操作不見得合理。因此才更能體現(xiàn)本文這種基于測試階段方法提出方法的優(yōu)越性。

可以發(fā)現(xiàn),本文提出的這種方法在不同數(shù)據(jù)集之間的遷移性非常之好。

結(jié)論

本文研究了如何充分挖掘預(yù)訓(xùn)練視覺-語言基礎(chǔ)大模型的更好零樣本學(xué)習(xí)能力。論文提出了Test-time Prompt Tuning, TPT),這種新的prompt調(diào)整方法,可以使用單個測試樣本動態(tài)學(xué)習(xí)自適應(yīng)提示。我們證明了該方法對自然分布變化的魯棒性跨數(shù)據(jù)集泛化,使用CLIP作為基礎(chǔ)模型。不需要任何訓(xùn)練數(shù)據(jù)或標(biāo)注,TPT提高了CLIP的zero-shot的泛化能力。

-

模型

+關(guān)注

關(guān)注

1文章

3499瀏覽量

50076 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1223瀏覽量

25303 -

Clip

+關(guān)注

關(guān)注

0文章

32瀏覽量

6987 -

自然語言

+關(guān)注

關(guān)注

1文章

291瀏覽量

13613 -

大模型

+關(guān)注

關(guān)注

2文章

3046瀏覽量

3862

原文標(biāo)題:面向測試階段的prompt搜索方式

文章出處:【微信號:GiantPandaCV,微信公眾號:GiantPandaCV】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

【大語言模型:原理與工程實(shí)踐】大語言模型的預(yù)訓(xùn)練

【大語言模型:原理與工程實(shí)踐】大語言模型的應(yīng)用

基于深度學(xué)習(xí)的自然語言處理對抗樣本模型

基于預(yù)訓(xùn)練視覺-語言模型的跨模態(tài)Prompt-Tuning

融合零樣本學(xué)習(xí)和小樣本學(xué)習(xí)的弱監(jiān)督學(xué)習(xí)方法綜述

如何更高效地使用預(yù)訓(xùn)練語言模型

利用視覺語言模型對檢測器進(jìn)行預(yù)訓(xùn)練

使用BLIP-2 零樣本“圖生文”

預(yù)訓(xùn)練數(shù)據(jù)大小對于預(yù)訓(xùn)練模型的影響

一個通用的自適應(yīng)prompt方法,突破了零樣本學(xué)習(xí)的瓶頸

基于預(yù)訓(xùn)練模型和語言增強(qiáng)的零樣本視覺學(xué)習(xí)

什么是零樣本學(xué)習(xí)?為什么要搞零樣本學(xué)習(xí)?

如何充分挖掘預(yù)訓(xùn)練視覺-語言基礎(chǔ)大模型的更好零樣本學(xué)習(xí)能力

如何充分挖掘預(yù)訓(xùn)練視覺-語言基礎(chǔ)大模型的更好零樣本學(xué)習(xí)能力

評論