整理 | 屠敏

出品 | CSDN(ID:CSDNnews)

ChatGPT、GPT-4 的迅速“出圈”,讓 OpenAI 一戰(zhàn)成名,外界對這家公司的關(guān)注度達(dá)到了前所未有的高度。

然而,欲戴王冠,必承其重。在如此前沿的技術(shù)到來之際,很多人將目光從技術(shù)本質(zhì)的探索延展到道德、風(fēng)險評估等維度。不久之前,CSDN 也曾報道過,非營利性的 "生命的未來研究所"(Future of Life Institute)發(fā)出一封公開信,以 LLM(Large Language Model)模型對社會和人類存在不可控的風(fēng)險為由,呼吁全球所有的 AI 實驗室都要暫停訓(xùn)練比 GPT-4 更強大的系統(tǒng),期限為六個月。包括圖靈獎得主 Yoshua Bengio、伯克利計算機科學(xué)教授 Stuart Russell、特斯拉 CEO 埃隆·馬斯克、蘋果聯(lián)合創(chuàng)始人 Steve Wozniak 等在內(nèi)的數(shù)千名對人工智能領(lǐng)域關(guān)注的學(xué)者、企業(yè)家、教授都在這封公開信上簽署了自己的姓名。雖然尚未直接點名,但是眾人心中都有數(shù),能以最快速度訓(xùn)練出比 GPT-4 更強大系統(tǒng)的公司屈指可數(shù),OpenAI 必在榜單的前列。所以這一封信究竟是為了阻止 OpenAI 加速前進(jìn)的步伐,還是真的擔(dān)心 LLM 帶來的弊會大于利,在業(yè)界尚未有統(tǒng)一的判定之前,因為這封信引發(fā)的輿論再次發(fā)酵,形成了兩派:

- 一派,認(rèn)為 “具有人類競爭智能的人工智能系統(tǒng)會對社會和人類構(gòu)成深刻的風(fēng)險”,甚至又有非營利機構(gòu)要求美國政府部門聯(lián)邦貿(mào)易委員會 FTC 出面調(diào)查 OpenAI,阻止 GPT-4 的商用;

- 另一派則認(rèn)可 LLM 對社會帶來的真實改進(jìn)和幫助,不能因部分人的顧慮而停止整個技術(shù)行業(yè)的發(fā)展。

那么,在兩派的爭論中,最終 LLM 的研發(fā)將何去何從?原本計劃將在今年下半年推出的 GPT-5 是否會如期?LLM 帶來的真實風(fēng)險又有哪些?

支持派:停止訓(xùn)練比 GPT-4 更強的模型

“只有當(dāng)我們確信它們的影響是積極的并且它們的風(fēng)險是可控的時候,才應(yīng)該開發(fā)強大的人工智能系統(tǒng)。因此,我們呼吁所有 AI 實驗室立即暫停訓(xùn)練比 GPT-4 更強大的 AI 系統(tǒng),至少 6 個月。這種暫停應(yīng)該是公開的和可驗證的,并且包括所有關(guān)鍵參與者。如果不能迅速實施這種暫停,政府應(yīng)介入并暫停“,公開信寫道。同時,其指出,「人工智能實驗室和獨立專家應(yīng)利用這次暫停期,共同制定和實施一套先進(jìn)的人工智能設(shè)計和開發(fā)的共享安全協(xié)議,并由獨立的外部專家進(jìn)行嚴(yán)格的審計和監(jiān)督」。當(dāng)然,信中也澄清說,“這并不意味著總體上暫停 AI 開發(fā),只是從越來越大且不可預(yù)測的黑盒模型的危險競賽中退后一步。”與此同時,據(jù)外媒 vice 報道,本次公開信發(fā)起者、圖靈獎得主 Yoshua Bengio 表示,“民主價值觀與這些工具的開發(fā)方式之間存在沖突”。 麻省理工學(xué)院 NSF AI 人工智能與基礎(chǔ)交互研究所(IAIFI)物理學(xué)教授、未來生命研究所所長 Max Tegmark 認(rèn)為,任由 AI 大模型繼續(xù)訓(xùn)練下去,最壞的情況是人類將逐漸失去對文明越來越多的控制權(quán)。他表示,當(dāng)前的風(fēng)險是“我們失去了對科技公司中一群未經(jīng)選舉的人的控制,他們獲得了巨大的影響力。”

事實上,微軟、Google 等大型科技公司之間早已拉起 AI 軍備競賽,他們在過去的一年里發(fā)布了很多新的人工智能產(chǎn)品。

不過,這種頻繁的發(fā)布節(jié)奏引起了公憤。繼公開信之后,就在昨日,另一家非營利性研究機構(gòu)人工智能和數(shù)字政策中心(Center for AI and Digital Policy,CAIDP)將狀告到了美國政府部門。他們要求聯(lián)邦貿(mào)易委員會(簡稱 FTC)調(diào)查 OpenAI,聲稱這家新貴公司發(fā)布了 GPT-4,違反了商業(yè)法,同時他們認(rèn)為該產(chǎn)品具有欺騙性并將人們置于危險之中。CAIDP 表示,"FTC 已經(jīng)宣布,人工智能的使用應(yīng)該是'透明的、可解釋的、公平的、有經(jīng)驗的,同時促進(jìn)問責(zé)制',不過 OpenAI 推出了一個有偏見、有欺騙性、對隱私和公共安全有風(fēng)險的產(chǎn)品。現(xiàn)在是 FTC 采取行動的時候了。”他們還批評了 OpenAI 在其模型和訓(xùn)練數(shù)據(jù)方面沒有實現(xiàn)透明。CAIDP 也敦促 FTC 對 OpenAI 展開調(diào)查,要求禁止 OpenAI 所有基于 GPT 產(chǎn)品的進(jìn)一步商業(yè)部署,對其技術(shù)進(jìn)行獨立評估,并確保其符合聯(lián)邦貿(mào)易委員會的規(guī)則,才能重新上市。

反對派:不能停止未來 GPT-5 以及更強模型的訓(xùn)練

雖然 OpenAI 自身也承認(rèn) GPT-4 并不完美,仍然會對事實驗證的問題產(chǎn)生錯亂感,也會犯一些推理錯誤,還偶爾過度自信,甚至連 OpenAI CEO Sam Altman 在接受外媒采訪時也曾表示過,公司對人工智能的潛力感到“有點害怕”。不過,Sam Altman 表示,這是“好事”,人工智能可能會取代許多工作,但它也可能會帶來“更好的工作”。而對于這封公開信的呼吁,諸多 AI 專家持反對意見。前谷歌大腦成員、在線教育平臺 Coursera 創(chuàng)始人吳恩達(dá)連發(fā)四條推文,強烈反對「暫停計劃」。他表示:呼吁在 6 個月內(nèi)暫停訓(xùn)練比 GPT-4 更強的模型是一個可怕的想法。我在教育、醫(yī)療、食品......方面看到了許多新的應(yīng)用,這將幫助許多人。改進(jìn) GPT-4 將是有實質(zhì)價值的。讓我們平衡一下人工智能正在創(chuàng)造的巨大價值與現(xiàn)實的風(fēng)險。

除非政府介入,否則沒有現(xiàn)實的方法來實施暫停令,阻止所有團(tuán)隊擴(kuò)大 LLM 的規(guī)模。不過,讓政府來暫停他們不了解的新興技術(shù)是反競爭的,樹立了一個可怕的先例,是糟糕的創(chuàng)新政策。

負(fù)責(zé)任的人工智固然重要,不過,人工智能也有風(fēng)險。媒體普遍認(rèn)為,人工智能公司正在瘋狂地輸出不安全的代碼,這不是事實。絕大多數(shù)(可悲的是,不是所有)人工智能團(tuán)隊都在認(rèn)真對待負(fù)責(zé)任的人工智能和安全研究。6 個月的暫停期并不是一個實用的建議。為了促進(jìn)人工智能的安全,圍繞透明度和審計的法規(guī)將更加實用,并產(chǎn)生更大的影響。在推動技術(shù)發(fā)展的同時,讓我們也對安全進(jìn)行更多的投資,而不是扼殺進(jìn)步。

也有人工智能專家批評這封信進(jìn)一步推動了“人工智能炒作”周期,而不是直接列出或呼吁針對當(dāng)今 LLM 存在的風(fēng)險采取具體的行動。

華盛頓大學(xué)語言學(xué)系教授、公開信中引用的第一篇論文的共同作者 Emily M. Bender 在推特上表示,「這封公開信 "摻雜了#Aihype"」,信中濫用了她的研究。公開信指出,"正如大量研究表明的那樣,具有人類競爭智能的人工智能系統(tǒng)會對社會和人類構(gòu)成深刻的風(fēng)險。"

不過,Bender 反駁說,"我們在 2020 年底寫了一篇論文(《隨機鸚鵡》,2021年發(fā)表),指出這種不考慮風(fēng)險就一頭扎進(jìn)越來越大的語言模型的做法是一件壞事。但風(fēng)險和危害從來都不是關(guān)于'太強大的人工智能'本身,相反:它們是關(guān)于權(quán)力集中在人的手中,關(guān)于壓迫制度的再現(xiàn),關(guān)于對信息生態(tài)系統(tǒng)的損害,以及關(guān)于對自然生態(tài)系統(tǒng)的損害(通過對能源資源的暴殄天物)。"

Hugging Face 的研究科學(xué)家兼氣候負(fù)責(zé)人 Sasha Luccioni 表示,“這(公開信)本質(zhì)上是誤導(dǎo):讓每個人都注意到 LLM 的假設(shè)權(quán)力和危害,并提出一種(非常模糊和無效的)解決方法,而不是此時此地正確看待風(fēng)險并嘗試解決這些問題——例如,在 LLM 出現(xiàn)時,可以要求相關(guān)企業(yè)對 LLM 的訓(xùn)練數(shù)據(jù)和能力實行更高的透明度,或有關(guān)何時何地可以使用它們進(jìn)行立法。”

GPT-4 以及后續(xù)更強的大模型為何成為眾矢之的?

截至目前,OpenAI 聯(lián)合創(chuàng)始人 Greg Brockman 倒是發(fā)了幾條推文,聲明了 GPT-4 模型的進(jìn)步與立場。他表示,”在現(xiàn)實世界的對抗壓力下部署 GPT-4 是對實際 AI 對齊的一次偉大實踐。雖然剛剛開始,但我們對迄今為止所取得的一致程度備受鼓舞(以及我們?yōu)楦纳茊栴}而不斷成熟的工程流程)。“Greg Brockman 說,可以通過一個例子觀察到,模型在如此廣泛的棘手或?qū)剐?a href="http://m.xsypw.cn/v/tag/" target="_blank">話題中的良好行為,大部分來自于模型已經(jīng)概括了人類導(dǎo)師的概念,即成為一個有幫助的人工智能助手。「在 GPT-3 中,它沒有辦法控制模型的行為。現(xiàn)在,我們選擇一組問題(例如,模型在錯誤的答案上頻率非常高——這曾經(jīng)是一個巨大的問題),可以建立評估,收集數(shù)據(jù),每周重新訓(xùn)練模型,并進(jìn)行部署。任何人都可以測試我們是否已經(jīng)改進(jìn)。但是對齊 GPT-4 只是其中一個環(huán)節(jié),而不是終點。這已經(jīng)實現(xiàn)了很大的進(jìn)步(與早期對 GPT-3 的抱怨相比),但需要進(jìn)一步擴(kuò)展到人類甚至無法判斷輸出的問題。」

其實,在 OpenAI 官方博客上,該公司也一直強調(diào),AI 需要對齊,「對齊研究旨在使人工智能(AGI)與人類價值觀保持一致并遵循人類意圖」。不過,OpenAI 的發(fā)聲并未獲得一些激進(jìn)派的認(rèn)可,而 OpenAI 之所以深陷輿論漩渦,或有兩方面的原因:一是 LLM 技術(shù)發(fā)展速度超出了很多人的意料,其中相關(guān)的法律法規(guī)、道德與使用等規(guī)范制度還存在很大的缺失。正如早些時候,Deepmind 研究團(tuán)隊在借鑒了計算機科學(xué)、語言學(xué)和社會科學(xué)的多學(xué)科文獻(xiàn)基礎(chǔ)上發(fā)布的《語言模型危害的倫理和社會風(fēng)險》論文中寫道的那樣,LM 會存在歧視、仇恨言論和排斥;信息泄露;虛假信息;惡意使用;人機交互;環(huán)境和社會經(jīng)濟(jì)等多重危害。因此,如何降低這些潛在危害,作為行業(yè)領(lǐng)頭羊的 OpenAI 必須要弄清楚,因為它的很多動作也是后來者參考的目標(biāo)。然而,現(xiàn)實來看,這也并不是 OpenAI 公司一家所需要考慮的事情,而是需要 AI 的所有參與者共同來制定。二是 OpenAI 樹大招風(fēng),尤其是 GPT-4 不透明性引發(fā)了很多人的不滿。自 ChatGPT、GPT-4 發(fā)布以來,已經(jīng)很多人批評過「OpenAI 不再 Open」了。不久前,Nomic AI 信息設(shè)計副總裁 Ben Schmidt 在推特上直指,OpenAI 在發(fā)布 GPT-4 技術(shù)的 98 頁論文中,絲毫沒有提及關(guān)于訓(xùn)練集內(nèi)容的任何信息。

也有網(wǎng)友稱,OpenAI 正在”假裝“開放。

不過,對于 LLM 究竟是應(yīng)該開源還是閉源,又是一個引發(fā)爭議的問題。針對這一點,據(jù)外媒 The Verge 報道,OpenAI 首席科學(xué)家、聯(lián)合創(chuàng)始人 Ilya Sutskever 在接受采訪時也曾回應(yīng)過,「OpenAI 不分享關(guān)于 GPT-4 的更多信息的原因是“不言而喻的”——害怕競爭和對安全的擔(dān)憂。」Sutskever 表示,“在競爭格局方面--外面的競爭很激烈。GPT-4 的開發(fā)并不容易。幾乎 OpenAI 的所有人在一起花了很長時間才做出了這個東西,而且(目前)有很多很多公司都想做同樣的事情。安全方面,我想說,還沒有競爭方面那么突出。但它將會改變,基本上是這樣的。這些模型非常強大,而且會變得越來越強大。在某種程度上,如果有人想的話,很容易用這些模型造成很大的傷害。隨著(模型)能力的增強,你不想透露它們是有道理的。”雖然從商業(yè)的角度,OpenAI 不公開大模型架構(gòu)(包括模型大小)、硬件、訓(xùn)練計算、數(shù)據(jù)集構(gòu)建、訓(xùn)練方法等細(xì)節(jié)合乎情理,但是也有人表示,不公開訓(xùn)練數(shù)據(jù),很難知道該系統(tǒng)可以在哪里安全使用并提出修復(fù)方案,不利于大模型的研究。為此,你是否支持暫停更強大模型的訓(xùn)練?你認(rèn)為大模型是開源好,還是閉源好?

-

AI

+關(guān)注

關(guān)注

87文章

31573瀏覽量

270384 -

人工智能

+關(guān)注

關(guān)注

1796文章

47704瀏覽量

240363

發(fā)布評論請先 登錄

相關(guān)推薦

OpenAI推出新模型CriticGPT,用GPT-4自我糾錯

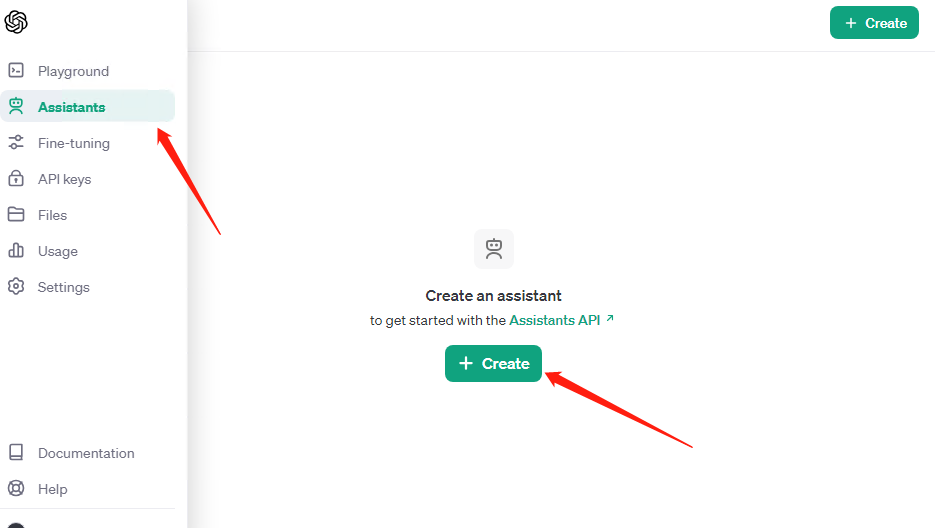

OpenAI API Key獲取:開發(fā)人員申請GPT-4 API Key教程

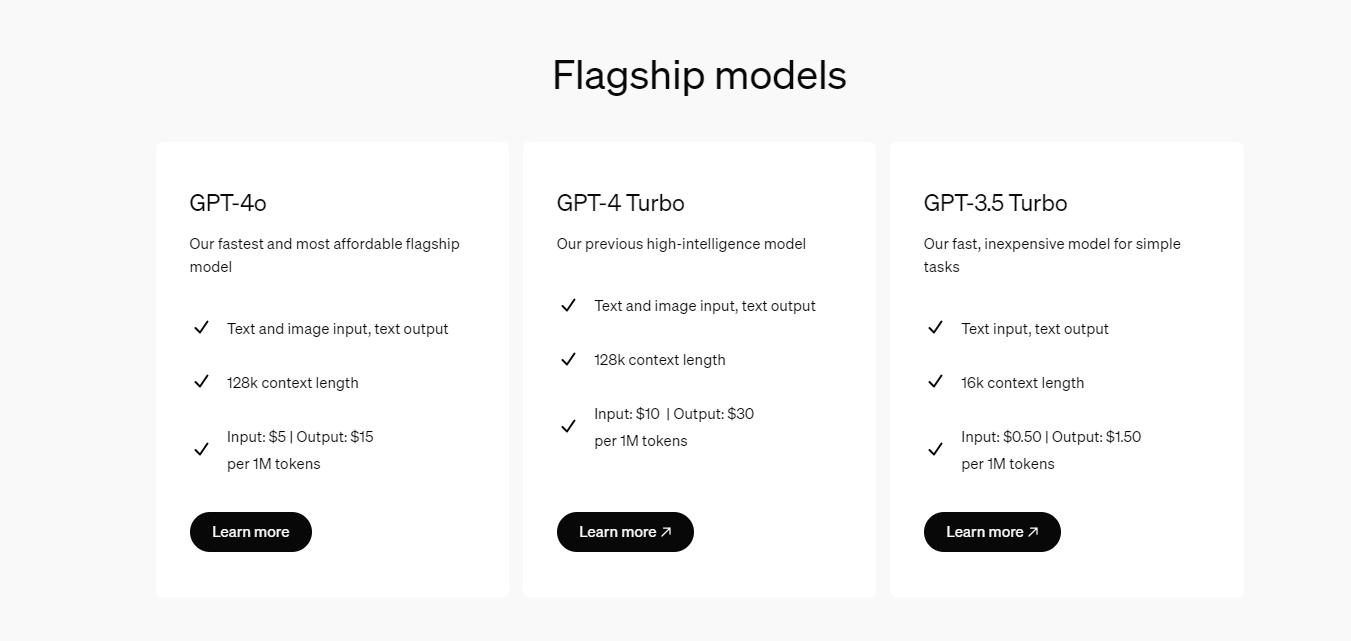

開發(fā)者如何調(diào)用OpenAI的GPT-4o API以及價格詳情指南

GPT-4人工智能模型預(yù)測公司未來盈利勝過人類分析師

OpenAI 深夜拋出王炸 “ChatGPT- 4o”, “她” 來了

OpenAI推出面向所有用戶的AI模型GPT-4o

OpenAI全新GPT-4o能力炸場!速度快/成本低,能讀懂人類情緒

OpenAI發(fā)布GPT-4o模型,供全體用戶免費使用

OpenAI計劃宣布ChatGPT和GPT-4更新

阿里云發(fā)布通義千問2.5大模型,多項能力超越GPT-4

GPT-4化身黑客搞破壞,成功率87%!OpenAI要求保密提示詞,網(wǎng)友復(fù)現(xiàn)ing

GPT-4 遭投訴要求禁用,OpenAI 為何成為眾矢之的?

GPT-4 遭投訴要求禁用,OpenAI 為何成為眾矢之的?

評論