作者:算力魔方創始人/英特爾創新大使劉力

一,什么是PaddleOCR工具庫?

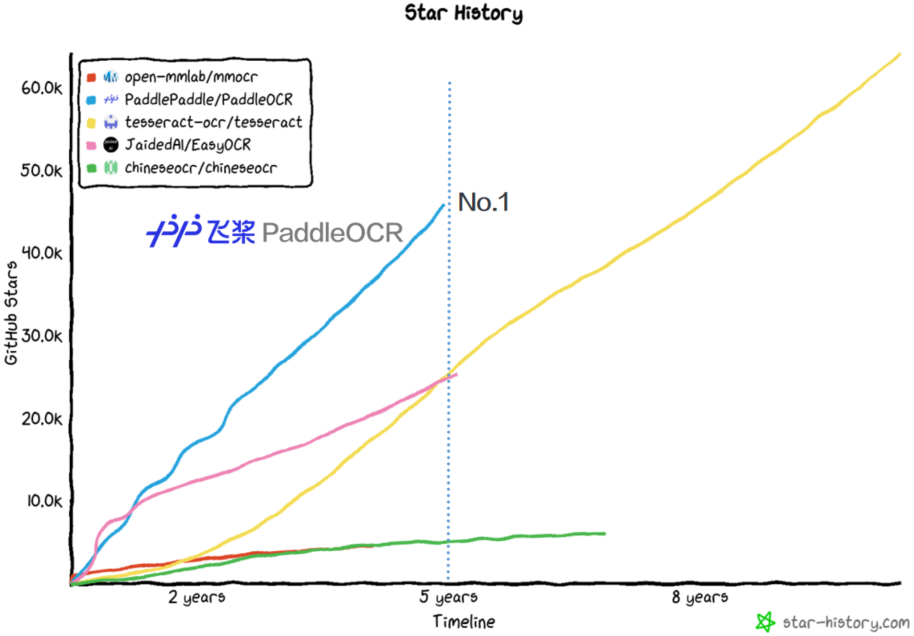

PaddleOCR 旨在打造一套豐富、領先、且實用的 OCR 工具庫,助力開發者訓練出更好的模型,并應用落地。在GitHub上與其它OCR開源庫相比,PaddleOCR在近五年發展時間內,擁有最多的星標(46k)、最快的星標增速、最多的貢獻者(234)和最活躍的社區支持!

PaddleOCR支持多種 OCR 相關前沿算法,在此基礎上打造產業級特色模型系列:PP-OCR、PP-Structure和PP-ChatOCR,打通了模型訓練、壓縮、部署全流程。

Github Repo: https://github.com/PaddlePaddle/PaddleOCR

二,什么是PP-OCRv4模型?

PP-OCRv4是PaddleOCR工具庫的PP-OCR系列模型中,當前性能最優的一個。它在前代模型(PP-OCRv3)的基礎上,針對檢測模型和識別模型進行了數據、網絡結構、訓練策略等多個模塊的優化,在多個應用場景中,精度均有大幅提升:

中文場景,相對于PP-OCRv3中文模型提升超4%;

英文數字場景,相比于PP-OCRv3英文模型提升6%;

多語言場景(支持韓語、日語、德語、法語等80種語言),平均準確率提升超8%。

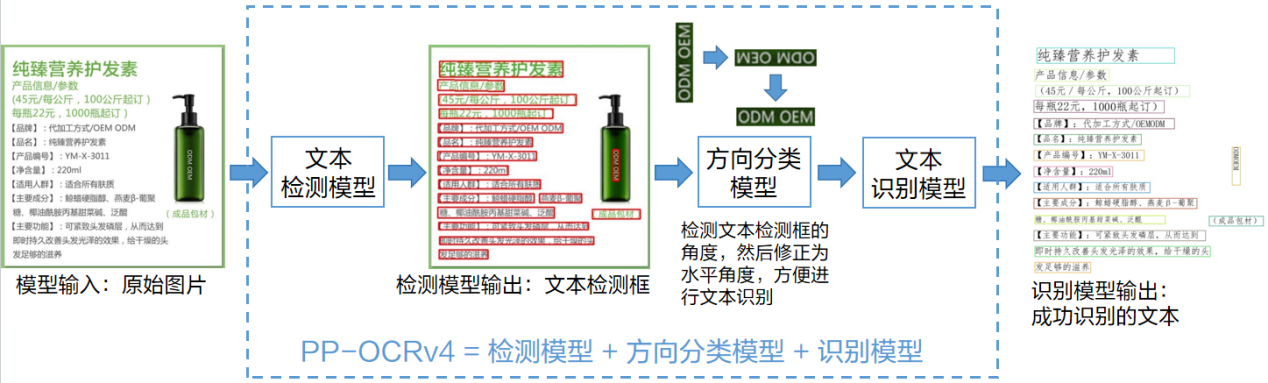

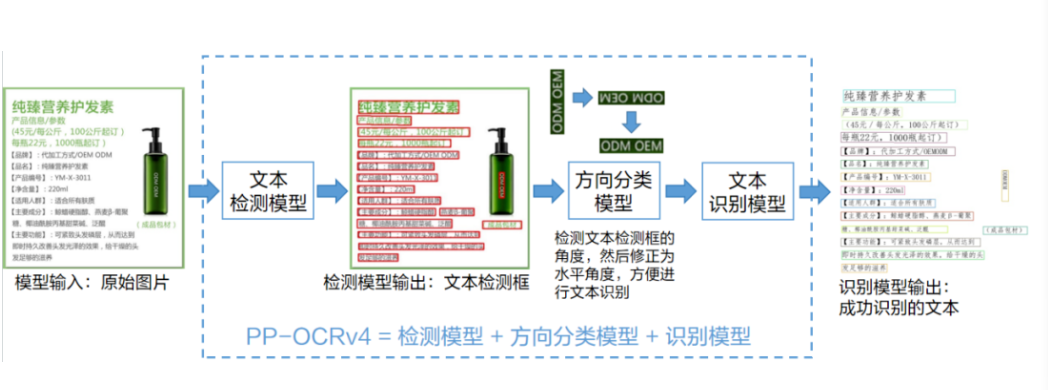

PP-OCRv4是一個兩階段的OCR系統,包含檢測模型、方向分類模型和識別模型。在檢測和識別之間添加方向分類模型,將不同角度的文本檢測框修正為水平檢測框,方便識別模型完成行文本識別。

為了適應服務器和邊緣端不同場景的部署需求,PP-OCRv4提供兩種推理模型權重版本:

邊緣端:中英文超輕量PP-OCRv4模型(16.1M) = 檢測模型(4.7M) + 識別模型(10.0M) + 方向分類模型(1.4M)。Hmean:62.24%;ACC:70.1%。

服務器端:中英文高精度PP-OCRv4 server模型(199.4M) = 檢測模型(110M) + 識別模型(88M) + 方向分類模型(1.4M)。Hmean:82.69%;ACC:84.04%。

PP-OCRv4模型鏈接:

https://github.com/PaddlePaddle/PaddleOCR/blob/main/docs/ppocr/blog/PP-OCRv4_introduction.md

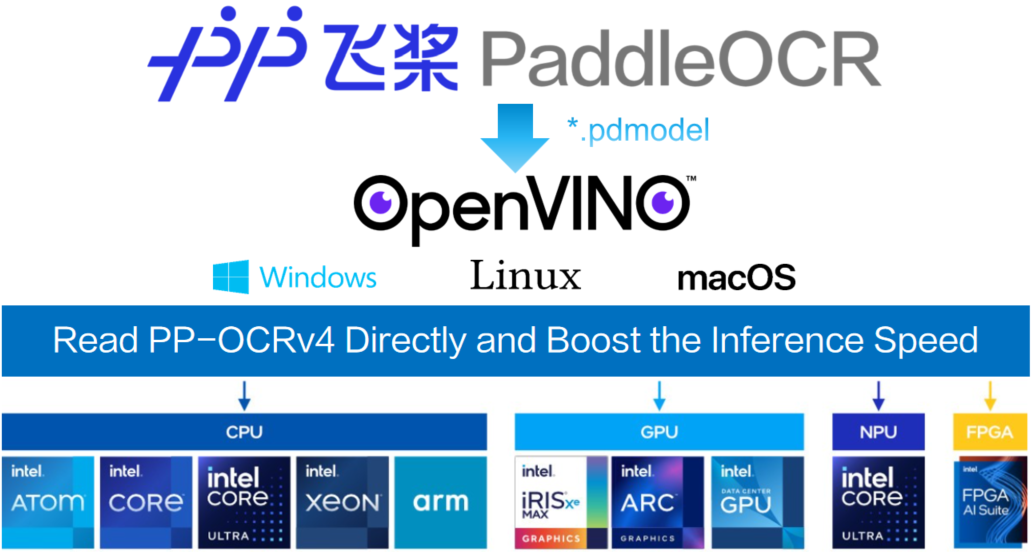

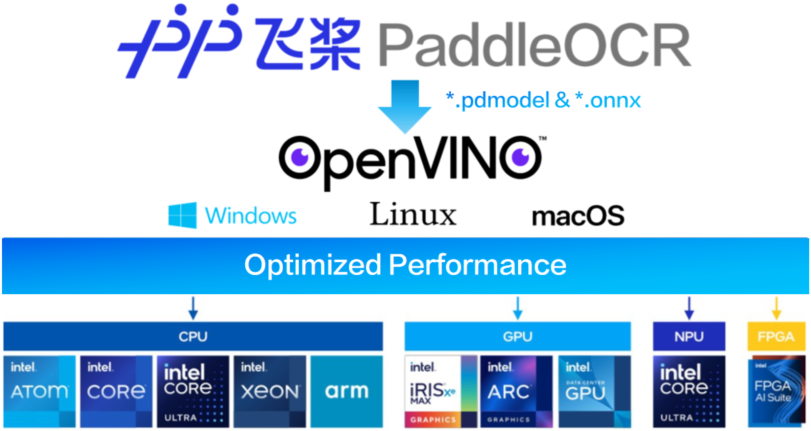

PP-OCRv4模型的卓越性能使其在多個領域具有廣泛的應用前景,如文檔掃描、文字提取、智能表單填寫、物流信息追蹤、文檔自動化處理、智能服務窗口、文獻資料整理等等。本文將介紹使用OpenVINO?工具套件在英特爾? CPU、獨立顯卡、集成顯卡和NPU上優化并部署飛槳PP-OCRv4模型。

三,OpenVINO?工具套件簡介

OpenVINO?工具套件是一個用于優化和部署人工智能(AI)模型,提升AI推理性能的開源工具集合,不僅支持以卷積神經網絡(CNN)為核心組件的預測式AI模型(Predictive AI),還支持以Transformer為核心組件的生成式AI模型(Generative AI)。OpenVINO?工具套件支持直接讀取并優化PaddlePaddle訓練好的模型(*.pdmodel),提升其在英特爾? CPU、獨立顯卡、集成顯卡、NPU等硬件上的AI推理計算性能。

四,搭建開發環境

您可以選擇無需搭建開發環境,直接在飛槳AIStudio星河社區上體驗范例:

https://aistudio.baidu.com/projectdetail/8770259

或者,在本地搭建開發環境,在算力魔方?上運行。

首先,請克隆PP-OCRv4_OpenVINO到本地:

git clone git clone https://github.com/openvino-book/PP-OCRv4_OpenVINO.git

cd PP-OCRv4_OpenVINO

接著,安裝依賴項:

pip install -r requirements.txt

最后,請從

https://paddlepaddle.github.io/PaddleOCR/latest/model/index.html

下載中英文超輕量 PP-OCRv4 模型,包括檢測模型、方向分類器和識別模型到PP-OCRv4_OpenVINO文件夾,并解壓。

下載命令:

# 下載并解壓PP-OCRv4的檢測模型

wget https://paddleocr.bj.bcebos.com/PP-OCRv4/chinese/ch_PP-OCRv4_det_infer.tar && tar -xvf ch_PP-OCRv4_det_infer.tar

# 下載并解壓PP-OCRv4的方向分類器

wget https://paddleocr.bj.bcebos.com/dygraph_v2.0/ch/ch_ppocr_mobile_v2.0_cls_infer.tar && tar -xvf ch_ppocr_mobile_v2.0_cls_infer.tar

# 下載并解壓PP-OCRv4的識別模型

wget https://paddleocr.bj.bcebos.com/PP-OCRv4/chinese/ch_PP-OCRv4_rec_infer.tar && tar -xvf ch_PP-OCRv4_rec_infer.tar

下載并解壓完畢后,開發環境搭建完成!

五,編寫PP-OCRv4推理程序

PP-OCRv4_OpenVINO項目已將推理程序編寫完成,各文件功能如下:

執行演示程序main.py,并指定模型路徑和推理硬件設備:

python main.py --image_dir images/general_ocr_006.png

--det_model_dir ch_PP-OCRv4_det_infer/inference.pdmodel

--det_model_device CPU

--rec_model_dir ch_PP-OCRv4_rec_infer/inference.pdmodel

--rec_model_device CPU

--cls_model_dir ch_ppocr_mobile_v2.0_cls_infer/inference.pdmodel

--cls_model_device CPU

--use_angle_cls True

運行結果,如下圖所示:

六,總結

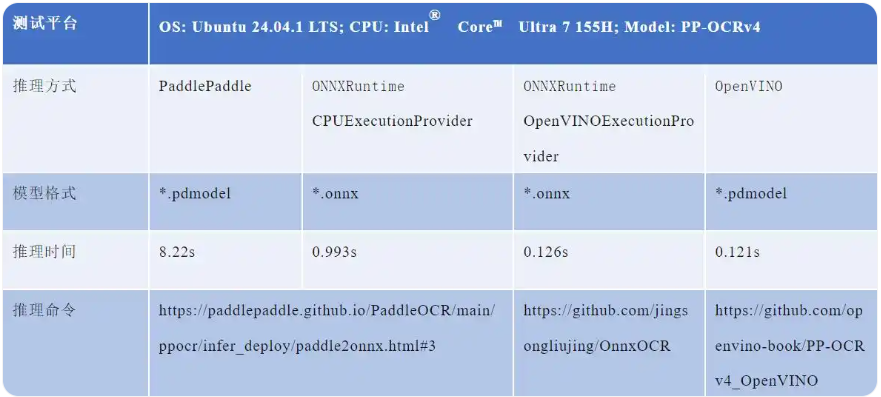

使用OpenVINO?可以直接讀入PP-OCRv4模型(無需轉換),并能方便快捷的將PP-OCRv4模型部署在含有英特爾? CPU、獨立顯卡、集成顯卡或NPU等硬件的算力魔方?上。

如果你有更好的文章,歡迎投稿!

稿件接收郵箱:nami.liu@pasuntech.com

更多精彩內容請關注“算力魔方?”!

審核編輯 黃宇

-

模型

+關注

關注

1文章

3513瀏覽量

50318 -

OpenVINO

+關注

關注

0文章

115瀏覽量

465

發布評論請先 登錄

PP-OCRv3優化策略詳細解讀

基于C#和OpenVINO?在英特爾獨立顯卡上部署PP-TinyPose模型

百度飛槳PP-YOLOE ONNX 在LabVIEW中的部署推理(含源碼)

使用OpenVINO C# API輕松部署飛槳PP-OCRv4模型

使用OpenVINO? 部署PaddleSeg模型庫中的DeepLabV3+模型

基于OpenVINO? 的飛槳版 PGNet 實現案例

基于NVIDIAGPU定制優化的NGC飛槳容器

NVIDIA 與飛槳團隊合作開發基于 ResNet50 的模型示例

在C++中使用OpenVINO工具包部署YOLOv5模型

基于OpenVINO?工具包部署飛槳PP-Human的全流程

【報名有獎】Imagination+百度飛槳模型部署實戰 Workshop 邀您參加

使用OpenVINO優化并部署訓練好的YOLOv7模型

基于OpenVINO C# API部署RT-DETR模型

基于算力魔方與PP-OCRv5的OpenVINO智能文檔識別方案

使用OpenVINO優化并部署飛槳PP-OCRv4模型

使用OpenVINO優化并部署飛槳PP-OCRv4模型

評論