隨著人工智能的發展和落地應用,以地理空間大數據為基礎,利用人工智能技術對遙感數據智能分析與解譯成為未來發展趨勢。本文以遙感數據轉化過程中對觀測對象的整體觀測、分析解譯與規律挖掘為主線,通過綜合國內外文獻和相關報道,梳理了該領域在遙感數據精準處理、遙感數據時空處理與分析、遙感目標要素分類識別、遙感數據關聯挖掘以及遙感開源數據集和共享平臺等方面的研究現狀和進展。首先,針對遙感數據精準處理任務,從光學、SAR等遙感數據成像質量提升和低質圖像重建兩個方面對精細化處理研究進展進行了回顧,并從遙感圖像的局部特征匹配和區域特征匹配兩個方面對定量化提升研究進展進行了回顧。其次,針對遙感數據時空處理與分析任務,從遙感影像時間序列修復和多源遙感時空融合兩個方面對其研究進展進行了回顧。再次,針對遙感目標要素分類識別任務,從典型地物要素提取和多要素并行提取兩個方面對其研究進展進行了回顧。最后,針對遙感數據關聯挖掘任務,從數據組織關聯、專業知識圖譜構建兩個方面對其研究進展進行了回顧。

除此之外,面向大智能分析技術發展需求,本文還對遙感開源數據集和共享平臺方面的研究進展進行了回顧。在此基礎上,對遙感數據智能分析與解譯的研究情況進行梳理、總結,給出了該領域的未來發展趨勢與展望。

引言

近幾年來,國內外人工智能的發展和落地應用如火如荼,促成這種現象的原因可以歸納為兩個關鍵詞,即“大數據”與“高算力”。在地理空間數據分析與應用領域,這種變化也正在發生著,比如在國家高分辨率對地觀測重大科技專項(簡稱“高分專項”)等國家重大任務的推動下,我們可獲取的地理空間數據越來越多,另外,以“云+端”架構為代表的高性能計算框架也在不斷發展,促進了算力的提升。在此背景下,以地理空間大數據為基礎,利用人工智能技術挖掘其深層信息、賦予其更多的應用模式,將成為未來地理空間數據分析應用領域發展的長期主題。

發展遙感數據智能分析技術的目的是將長期積累的遙感數據轉化為對觀測對象的整體觀測、分析、解譯,獲取豐富準確的屬性信息,挖掘目標區域的演化規律,主要包括遙感數據精準處理、遙感數據時空處理與分析、遙感目標要素分類識別、遙感數據關聯挖掘等。此外,面向大智能分析技術發展需求,遙感開源數據集和共享平臺方面也取得了顯著進展(陳述彭等, 2000; 宮輝力等, 2005)。

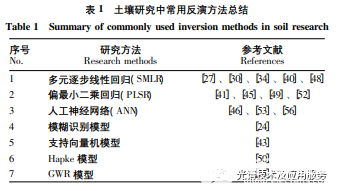

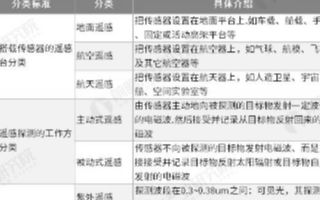

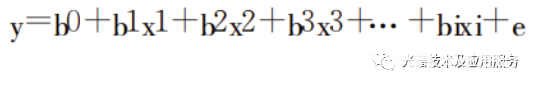

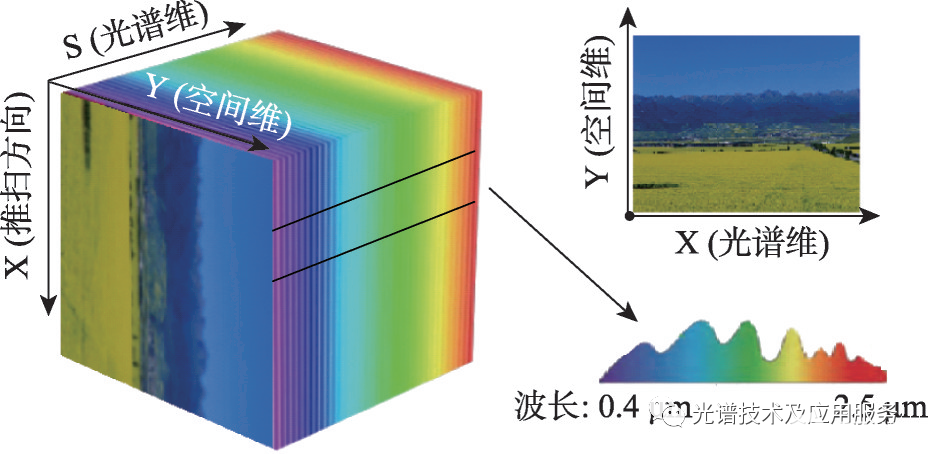

遙感數據精準處理方面,遙感數據精準處理的目的是對傳感器獲取的光譜反射或雷達散射數據進行成像處理和定標校正,恢復為與地物觀測對象某些信息維度精確關聯的圖像產品。傳統方法需要根據衛星、傳感器、傳輸環境、地形地表等先驗模型,以及外場定標試驗獲取定標參數,建立精確的成像模型將觀測數據映射為圖像產品。隨著傳感器新技術的發展和分辨率等性能的提升,先驗模型的建立越來越困難,外場定標的難度和消耗也越來越大,并且成像處理和定標校正獲取的模型和參數與傳感器的耦合,只能以一星一議的方式實現,無法多星一體化實現。如何在傳統方法的基礎上,構建觀測數據到精準圖像產品的深度學習網絡結構,設置面向不同應用的圖像優化指標體系,以大量歷史數據和標注結果作為輸入,實現網絡結構對傳感器物理模型和參數的精確重構和逼近,形成基于人工智能技術的多星一體化遙感圖像精準處理能力。

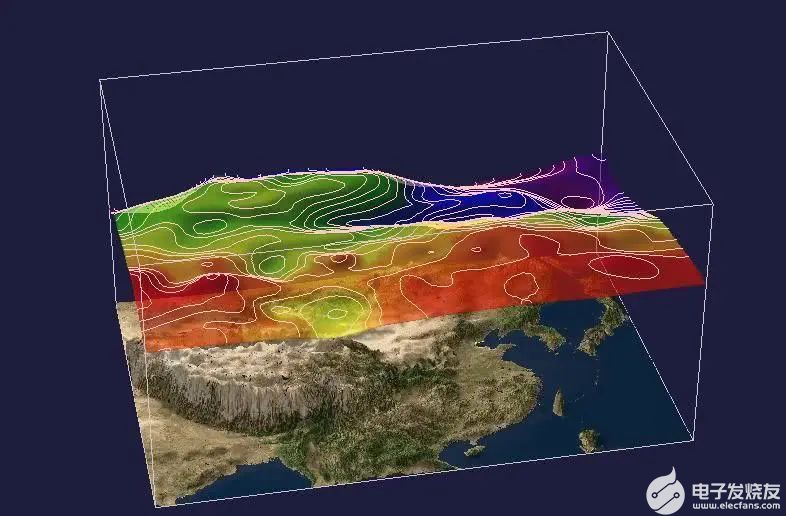

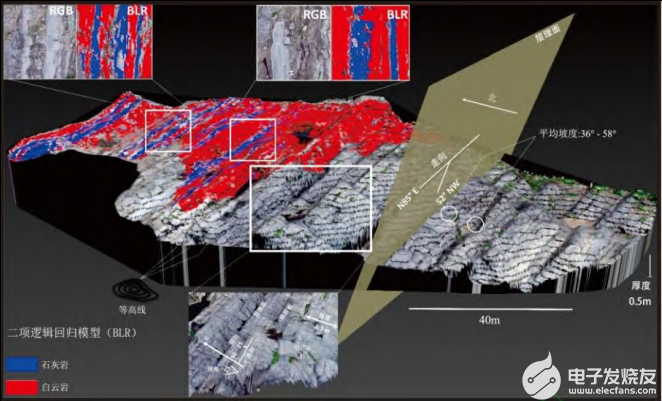

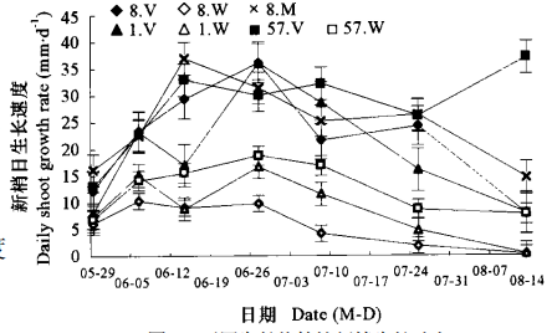

遙感數據時空處理與分析方面,多時相影像相比單一時相的遙感影像,能夠進一步展示地表的動態變化和揭示地物的演化規律。然而,一方面受限于遙感自身的時間分辨率與空間分辨率之間的不可兼得;另一方面受氣象、地形等成像條件的影響,光學傳感器獲取的遙感影像往往被云層及其陰影覆蓋(特別是在多云多雨地區,如我國西南地區),而難以獲取真實的地面信息。這樣的數據缺失,嚴重限制了遙感影像的應用;特別是對于多時相影像的遙感應用(如森林退化、作物生長、城市擴張和濕地流失等監測),云層及其陰影所導致的數據缺失將延長影像獲取的時間間隔、造成時序間隔不規則的問題,加大后續時間序列處理與分析的難度。因此,進行遙感影像的時間與空間維度的處理與分析對提高遙感影像數據的可用性、時間序列分析水平和遙感應用的深度廣度具有重要意義。

遙感目標要素分類識別方面,遙感數據中一般包含大量噪聲,大多數現有的處理分析方法并未充分利用計算機強大的自主學習能力,依賴的信息獲取和計算手段較為有限,很難滿足準確率、虛警率等性能要求。如何在傳統的基于人工數學分析的方法基礎上,結合人工智能方法,定量描述并分析遙感數據中目標模型失真和背景噪聲干擾對于解譯精度的影響機理,是遙感智能分析面臨的另一項關鍵科學問題。通過該問題的分析與發展,有望實現構建一個基于深度學習的多源遙感數據自動化分析框架,在統一框架下有機融合模型、算法和知識,提升遙感數據中目標要素提取和識別的智能化水平。

遙感數據關聯挖掘方面,隨著遙感大數據時代的到來,我們可以更方便地獲取高分辨率和高時間采集頻率的遙感數據,對于目標信息的需求,也由目標靜態解譯信息,拓展到全維度的綜合認知與預測分析。為了滿足上述需求,基于海量多源異構遙感數據,實現時間、空間等多維度的信息快速關聯組織與分析,是未來遙感解譯技術發展的重要方向。

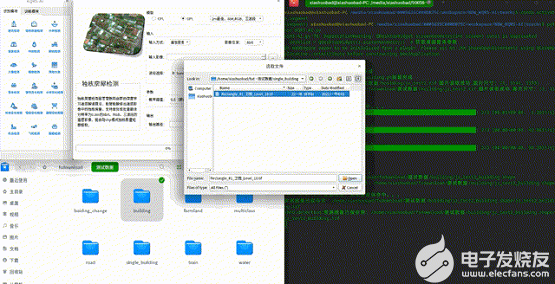

遙感開源數據集和共享平臺方面,大多數現有數據集仍然存在數據規模較小、缺乏遙感特性的問題,并且現有深度學習平臺難以有效支撐遙感特性及應用,領域內數據集算法模型的準確性、實用性、智能化程度也待進一步提高。如何結合遙感數據特性,建設更具遙感特色的開源數據集和共享平臺,是遙感智能生態建設的一項重要研究內容。本文主要圍繞上述五個方面的研究,論述遙感智能分析技術的發展現狀、前沿動態、熱點問題和未來趨勢。

01國際研究現狀

1.1遙感數據精準處理

利用智能手段開展數據預處理技術,國外將智能技術用于遙感數據(光學、SAR、光譜)配準、校正等的工作。

1.1.1光學/SAR 精細化處理

遙感圖像為遙感應用分析提供了數據基礎,可廣泛應用于農林監測、城市規劃、軍事偵察等領域,遙感數據質量是決定其應用性能的關鍵。評價遙感數據質量的指標包括圖像時間/空間分辨率、圖像幅寬、空間特征、光譜特征、輻射幾何精度等。高質量遙感影像具有高分辨率、高信噪比等特點。提升遙感影像質量的方法可大致分為兩類,一是改進傳統成像算法聚焦得到高質量圖像;二是將已有的低質量的圖像通過去噪去云以及超分辨率重建等技術得到高分辨率高質量圖像。與傳統的 SAR成像算法比較,基于深度學習的SAR 成像算法可以簡化成像過程。Rittenbach等人(2020)提出 RDAnet 神經網絡從原始雷達回波數據訓練聚焦得到SAR圖像,網絡經過訓練可以匹配距離多普勒算法的性能,算法將SAR成像問題處理為監督學習問題,RDAnet是第一個基于深度學習的SAR 成像算法。Gao等人(2019)提出了一種基于深度網絡的線譜估計方法,并將其應用于三維 SAR成像,大大加快了成像過程。Pu(2021)提出了一種深度 SAR 成像算法,減少了 SAR 的采樣量,并且提出了一種基于深度學習的 SAR 運動補償方法,可以有效地消除運動誤差的影響。僅依賴遙感衛星載荷能力推動圖像分辨率提升,使得高分辨率圖像成本大幅提高,給遙感圖像大規模應用力帶來困難。以超分辨、圖像重構等為代表的圖像級和信號級處理方法為遙感圖像分辨率和質量提升提供了另一種可行的技術途徑。Wei 等人(2021)提出了基于 MC-ADM 和基于 PSRI-Net 的兩種參數化超分辨率 SAR 圖像重建方法,根據預先設計的損耗,深度網絡通過端到端訓練來學習,可應用于得到高質量 SAR 超分辨率圖像的參數估計。Luo 等人(2019)提出了一種基于卷積神經網絡的SAR 圖像超分辨率重建的方法,針對浮點圖像數據采用深度學習對 SAR 圖像進行重建,可以更好地重建SAR圖像。針對非生成對抗網絡在光學遙感圖像超分辨重建以及噪聲去除中出現的信息損失和對比度降低的問題,Feng(2020)提出了利用生成對抗網絡對小波變換域光學遙感圖像進行超分辨重建以及噪聲去除的方法。Xiong(2021)提出了一種適應于遙感圖像超分辨的改進超分辨率生成對抗網絡(Super-resolution GAN, SRGAN),增強了模型在跨區域和傳感器的遷移能力。Bai 等人(2021)提出一種改進的密集連接網絡遙感圖像超分辨重建算法。Dong等(2020)提出了一種改進的反投影網絡實現遙感圖像的超分辨率重建。Tao(2020)提出了一種以 DPSRResNet 作為其超級解析器的 DPSR 框架的遙感圖像超分辨重建算法。Yang 等(2020)提出了一種多尺度深度殘差網絡(MDRN)用于從遙感圖像中去除云。Wang 等(2021)構建了 SAR 輔助下光學圖像去云數據庫,建立了基于條件生成對抗網絡的 SAR 輔助下的光學遙感圖像去云模型,實現了SAR輔助下光學圖像薄云、霧、厚云等覆蓋下地物信息的有效復原與重建。

目前,人工智能在遙感數據處理和圖像質量提升方面的應用主要得益于機器學習技術的引入。基于GAN 網絡的方法試圖利用生成器克服原始高分辨率遙感圖像難以獲取的問題,另一些無監督的學習方法則通過學習圖像質量退化前后關系試圖獲取原始的高分辨率遙感圖像。由于遷移學習可以從其它域樣本中獲得先驗信息,并且在目標域中進一步優化,借鑒遷移學習和零樣本學習的思路可以嘗試解決遙感圖像質量提升的問題。由于作用距離遠,遙感圖像分辨率和清晰度相對于自然圖像仍有一定的差距,這導致遙感圖像細節丟失相對較為嚴重。

為了從遙感圖像中獲取更為豐富的信息,需要對遙感圖像空間特征進行提取(注意力機制、局部-全局聯合特征提取等),需要對遙感圖像目視效果進行可視化增強(邊緣增強、小波變換等)。此外,面向圖像細節特征解譯的需求,還需要對遙感圖像中的弱小目標和細微結構進行檢測、提取和增強(弱小目標檢測等),提升遙感圖像中細節缺失造成的信息損失。

1.1.2光學/SAR 定量化提升

可見光、SAR、高光譜等遙感圖像的定量化提升主要體現在幾何、輻射、光譜、極化等幾個方面,通過尋找穩定點來消除成像過程中產生的畸變,改善圖像質量,使數據產品能夠定量化反映地物的真實信息,以達到定量化提升的效果。在國際主流研究中,神經網絡技術主要被應用在提升圖像匹配精度方面,并以此帶動幾何定位精度定量化提升。得益于機器學習方法的引進,遙感圖像匹配技術獲得了系統性發展,匹配精度獲得了顯著進步。典型的兩種方法為局部特征點匹配方法和區域匹配方法。與全局特征相比,局部特征點與遙感圖像獲取的大場景松耦合,對大場景的仿射變化、輻射/亮度變化噪聲水平不敏感。目前,基于特征點匹配的遙感圖像質量提升技術取得了一系列研究成果。典型的特征點匹配包括關鍵點檢測和描述子提取兩個部分。深度學習應用于局部特征點匹配可以分成三個階段,形成了三類代表性方法。第一類方法重點關注和解決關鍵點檢測問題,即如何檢測得到特征點的方向、位置、以及尺度信息。關鍵點檢測中響應圖的構建是重點,關鍵點檢測的數量和準確性依賴于特征準確、信息豐富的響應圖。Savinov 等人(2017)提出了無監督學習的神經網絡訓練方法,該方法首先將遙感圖像目標像素點映射為實值響應圖,進而排列得到響應值序列,響應序列的頂部/底部像素點即可以視為關鍵點。Ma 等人(2019b)采用由粗到細的策略,先用一個卷積神經網絡計算近似空間關系,然后在基于局部特征的匹配方法中引入考慮空間關系的匹配策略,同時保證了精度和魯棒性。第二類方法重點關注和解決描述子提取問題,即用一組特征向量表示描述子,描述子代表了特征點的信息,可以通過端到端訓練獲得描述子。描述子訓練是獲得高精度匹配結果的關鍵。Simo-Serra 等人(2015)提出了 Deep-Desc 特征點描述子提取方法,該方法中神經網絡采用了 Siamese 結構(Chopra等, 2005),構造了一種 128 維的描述子,應用于具有一定差異性的圖像對匹配問題,通過比較描述子歐氏距離對圖像間描述子的相似性進行衡量。第三類方法關注于聯合訓練關鍵點檢測模塊和描述子提取模塊。關鍵點檢測和描述子提取兩個模塊的協同工作和聯合訓練是該方法重點解決的難點。Yi 等人(2016)提出了基于 LIFT 網絡的聯合訓練,是最早解決關鍵點檢測和描述子提取的聯合訓練的網絡之一。LIFT 網絡的輸入是以 SIFT 特征點(Lowe, 2004)所在圖像塊,LIFT 網絡的關鍵點檢測效果也與 SIFT算法類似,魯棒性較好。Ono 等人(2018)提出的LF-Net,采用 Siamese 結構訓練整個網絡,通過深層特征提取網絡產生特征圖。Shen 等人(2019)以LF-Net 為的基礎,提出了基于感受野的 RF-Net 匹配網絡,該網絡實現關鍵點檢測時保留了遙感圖像低層特征、部分保留了遙感圖像高層特征,在描述子提取中采用了與 Hard-Net(Mishchuk 等, 2017)一致的網絡結構。與局部特征點相比,區域特征對整體性表征更加完整,對區域形變、區域變化等的穩定性更好。傳統區域特征匹配技術的代表為模板匹配方法。深度學習應用于區域特征匹配形成了兩類代表性方法。第一類方法的核心思想是用分類技術解決匹配問題。Han 等人(2015)利用 MatchNet 提取圖像區域特征,將三個全連接層得到特征的相似性作為輸出,對輸出采用概率歸一化處理(Softmax)進行分類匹配。Zagoruko 等人(2015)重點解決了對光照變化、觀測角度具有很好適應性的區域特征提取問題,提出了基于DeepCompare 網絡的區域特征提取方法,該方法的匹配性能對于不同時間空間獲取的遙感圖像具有極佳的穩定性。第二類方法的核心思想是構建合適的描述子解決區域特征匹配問題。Tian 等人(2017)提出了一種 L2-Net網絡的區域匹配方,該網絡生成了128 維的描述子,在迭代次數較少的約束下,利用遞進采樣策略,對百萬量級的訓練樣本進行遍歷學習,并通過額外引入監督提高學習效率,該網絡泛化能力較好。

可見,深度學習網絡的引入在特征提取、關鍵點檢測和描述子提取等多方面優化了遙感圖像匹配能力。考慮到深度學習網絡的持續研究,網絡結構、訓練方式的更新和進步有望進一步提升遙感圖像匹配精度,基于深度學習的遙感圖像匹配算法仍然具有相當的研究價值和應用前景。

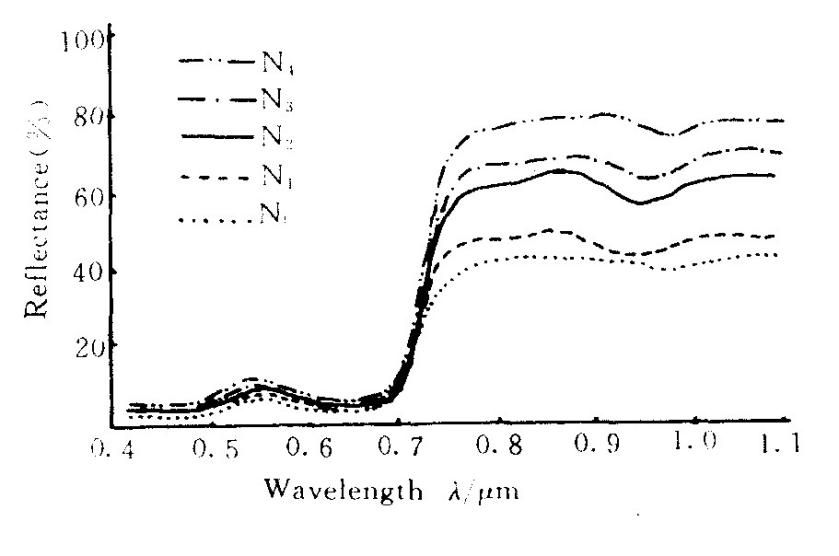

除了幾何質量定量化提升外,還有少數研究學者開展了利用神經網絡技術在輻射、光譜、極化定量化提升方面的研究工作。楊進濤等人(2019)提出了一種基于海量 SAR 數據進行地物散射穩定特性的分析與挖掘,并成功在普通地物中找到一種統計意義下穩定的散射特征量用作定標參考,從而為SAR 系統的常態化輻射定標奠定初步的技術基礎。Jiang 等人(2018)考慮到極化觀測過程中會受到多種誤差的影響,造成極化測量失真,影響數據的極化應用性能,提出一種利用普遍分布的地物進行串擾和幅相不平衡的定量評價方法,該方法不受時間和空間限制,能夠實現大量數據極化校正性能的實時、便捷評估,對極化數據質量進行長期監測。和幾何定量化提升不同,神經網絡技術在這些領域還沒有大量的、深入的應用,為后續進一步進行系統性、規模化研究提供了指導方向。

1.2遙感數據時空處理與分析

近年來,陸續開展多源遙感時間與空間協同處理與分析方面開展研究工作,力求實現多源數據間互補協同、融合重建,提高遙感時空分析的能力

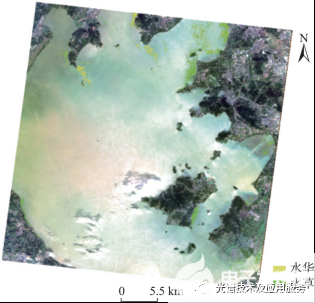

1.2.1遙感影像時間序列修復

研究人員構建了大量的時間序列遙感影像修復和重建的方法。根據修復所用參考數據的不同,這些方法大致可以分為三類:基于影像本身的修補方法(self-complementation-based)、基于參考影像的修補方法(reference-complementation-based)和基于多時相影像的修補方法(multi-temporal-complementation-based)。基于影像本身的修復方法利用同一影像上無云/影覆蓋區域的數據來修補被云/影覆蓋區域的缺失數據;假設影像中數據缺失區域與剩余區域具有相似或相同的統計與幾何紋理結構,通過傳播局部或非局部無云區域的幾何結構來重建云/影區域的缺失數據。依據空間插值與誤差傳播理論,缺失像素插值(missingpixel interpolation)、影像修補(image inpainting)和模型擬合(model fitting)等多種方法被廣泛應用于云影區域的數據重建。雖然能夠重建出貌似真實的影像區域,但這些方法對云/影覆蓋下地物的類型非常敏感,其修補數據也不適用于進一步的數據分析;并且由于不確定性和誤差隨著傳播而積累,這些方法很難修復大區域或異質缺失數據。為了克服基于影像本身修補方法的瓶頸,Chen 等人(2016)提出了通過模擬參考影像與云/影覆蓋影像之間映射與轉換關系的基于參考影像修補方法;這類方法依賴于不同光譜數據之間的強相關性,利用多光譜或高光譜影像中對云不敏感的光譜波段來重建被云/影覆蓋區域其他波段的缺失數據。比如利用 MODIS數據的第七波段來修復第六波段的數據缺失、利用Landsat 近紅外波段來估算水面區域的可見光波段、利用MODIS數據預測 Landsat 影像的缺失數據和利用不受云雨干擾的合成空間雷達數據來重建被云影覆蓋的光學數據等。盡管參考影像能夠提供云影覆蓋區域的缺失信息,但這類方法仍然受到光譜一致性、空間分辨率和成像時間相關性等限制,而難以重建出高質量的用于模擬地表變化的時間序列數據。前兩種方法受限于其對重建影像沒有漸進變化的假設,這種平穩性假設將成為土地覆蓋變化和作物生長監測等時間序列應用中的明顯弱點。遙感衛星以固定的重復周期來觀測地表,同一區域又不可能總是被云影覆蓋,因此很容易獲得同一區域的多時相影像。這些同一區域的多時相影像(有云/影覆蓋的和無云/影覆蓋的)提供了利用多時相影像修復云/影覆蓋區域缺失影像的可能(Chen 等, 2011)。基于多時相影像的修補方法包括兩個主要步驟:查找有云/影覆蓋區域和無云/影覆蓋區域相似的像元(pixel)或區域(patch)和利用相似的像元(區域)預測云/影覆蓋區域的缺失數據。在查找相似像元中,Roy 等人(2008)深入研究并集成空間、光譜和時相等信息來度量有云/影覆蓋區域和無云/影覆蓋區域像元的相似性。在重建云/影覆蓋像元中,Gao等(2017)提出和發展了諸如多時相直接替換、基于泊松方程的復制、時空加權插值等方法;同時也吸納用于修復傳感器條帶修復的方法,如近鄰相似像元插值(neighborhood similar pixel interpolator,NSPI)(Zhu 等, 2011)和加權線性回歸(weightedlinear regression,WLR)等。近年來,深度學習方法也被運用于云影覆蓋影像的修復和重建;Grohnfeldt 等人(2018)利用生成對抗網絡(generative adversarial networks)來融合合成空間雷達數據和光學影像生成無云影像;Malek等人(2017)利用自動編碼網絡(autoencoder neuralnetwork)來構建有云影覆蓋區域和無云影覆蓋區域影像的映射函數;Zhang 等人(2018a)利用深度卷積網絡(deep convolutional neural networks)集成光譜、空間和時相信息來修復缺失數據。

雖然現有研究取得了不錯的重建效果,但仍存在一些局限性:(1)相對于光譜和空間相似性,多時相影像中的時間趨勢能更詳細地反映地表覆蓋變化,而以往方法(尤其是傳統方法)中的簡單線性回歸或光譜、空間度量很難捕捉復雜的非線性時間趨勢;(2)現有的利用深度學習的重建方法多集中運用空間卷積網絡 CNN 獲取光譜和空間紋理信息(且需要大量的訓練樣本),少有研究使用循環神經網絡 RNN學習跨影像的時間趨勢;(3)由于云/影總在不確定的影像區域和不確定的時間上出現,像元級的時間序列難以保證多時相影像的時間間隔相等與時相對齊,加大了現有方法進行時間序列重建的難度。

1.2.2多源遙感時空融合

遙感圖像融合研究可大致分為兩個階段。第一階段主要集中于全色增強算法研究,即通過融合來自同一傳感器的全色波段和多光譜波段進而生成高分辨率的多光譜圖像。這類算法研究較多,已形成較為成熟的系列算法。第二階段則是多源多分辨的時空融合算法研究,即通過融合高空間分辨率遙感數據的空間分辨率特征和高時間分辨率遙感數據的時間分辨率特征,進而生成兼具高時間和高空間分辨率的遙感數據。這類研究從最近十幾年才發展起來,仍處于快速發展階段,研究成果相對較少,但是對遙感數據的應用具有重要意義。時空融合算法研究最早出現在 2006 年美國農業部 Gao(2006)的研究中。其在 Landsat ETM+和MODIS 數據地表反射率的融合中提出一種時空自適應反射率融合模型(Spatial and Temporal AdaptiveReflectance Fusion Model,STARFM),可融合生成具有和 Landsat ETM+數據一樣空間分辨率的逐日(和 MODIS 數據時間分辨率一樣)地表反射率數據。此后,系列基于 STARFM 或其他理論框架的融合算法相繼被提出。當前的時空融合算法根據其融合原理可大致分為三種:基于解混、基于濾波和基于學習的方法。基于解混的方法,通過光譜替換的方式生成融合圖像。基于濾波的方法,待預測像元值通過對其一定鄰域內光譜相似像元的加權求和獲得。而基于學習的方法(Huang 等, 2012; Song 等,2012),首先通過學習待融合傳感器圖像之間的映射關系,然后將先驗圖像的信息融入融合模型最終生成融合圖像。基于學習的時空融合研究起初多在 MODIS 和Landsat 這兩類遙感圖像上。如針對這兩類數據的融合,Song 等人(2012)提出基于稀疏表示的時空反射融合模型。該模型在已知兩對 MODIS 和 Landsat圖像對差分域中學習它們的映射關系,形成字典對信息。而因為兩者圖像的空間分辨率存在較大差異,作者設計了兩層融合框架,使得基于稀疏表示的方法大大提高了融合精度,但字典對中存在擾動的問題一直不可忽視。Wu 等人(2015)通過引入誤差邊界正則化的方法到字段對學習中解決了擾動問題。近年來,因深度卷積神經網絡在各類圖像領域表現出良好性能,Song 等人(2018)提出基于卷積神經網絡的遙感圖像時空融合算法(SpatiotemporalSatellite Image Fusion Using Deep ConvolutionalNeural Networks,STFDCNN)。他們的模型分兩階段進行學習,首先學習降采樣 Landsat 圖像(lowspatial resolution,LSR)與 MODIS 圖像之間的非線性映射關系;其次學習 LSR Landsat 圖像與原始Landsat 圖像之間的超分辨率映射關系。通過這兩階段學習模型實現對遙感圖像中豐富細節信息的利用。盡管 STFDCNN 模型在時空融合性能上大幅度超過其他融合算法,但因其神經網絡層數較少(僅有 3 個隱藏層),如此淺層的卷積神經網絡對存在較大空間尺度差異的不同衛星傳感器數據(MODIS-Landsat)間的非線性映射關系的學習仍是有難度的。因此,當前如何處理兩類傳感器數據(MODIS-Landsat)之間的空間差異變化,以及如何確定深度卷積網絡的最優層數和卷積核數目仍舊是卷積神經網絡時空融合算法研究中亟待解決的問題。此外,Kim 等人(2016)在超分辨重建研究中,通過利用殘差網絡結構得以訓練一個深度的卷積神經網絡模型,這對后續遙感圖像融合研究具有一定啟發。

1.3遙感目標要素分類識別

經典遙感要素分類與識別方法一般為“單輸入單輸出”的模型架構,面向不同目標要素、不同模態數據或不同分類識別任務時,通常設計不同的專用網絡模型。而我們實際面臨的應用場景中,常會有不同模態的數據供我們使用,并給出多種類型的決策結果,例如,人類的感知系統會結合聽、說、看等多種輸入,并給出目標的位置、屬性等多種信息。而傳統的模型架構難以實現這種“多輸入多輸出”的能力,主要問題在于,一是傳統模型對新場景、新任務的適應能力不足;二是模型對各類數據的特征提取過程相對獨立,難以實現不同數據的特征共享從而實現性能增益;三是在多輸入多輸出情況下,傳統模型的簡單疊加會導致計算和空間復雜度的顯著上升,限制其實用能力。為了解決上述問題,當前的主流發展方向是多要素目標信息并行提取,通過在網絡模型中探索多模態數據、多任務多要素特征的共享學習,在降低模型復雜度的同時提升其泛化能力。

1.3.1典型遙感目標要素提取

傳統的遙感目標要素提取方法面向不同目標要素時,通常設計不同的專用的方法流程。這種流程設計主要解決兩類問題,一是針對遙感數據本身的特征/特性分析,為構建適合數據特征/特性的模型提供依據;二是適合遙感數據特點的專用網絡模型構建,即以通用的網絡模型為基礎,構建符合遙感數據特點的模型,改進通用模型在遙感數據中的應用能力。遙感數據的獲取過程中存在諸多與自然場景圖像不同的影響因素,如電磁波散射特性、大氣輻射特性、目標反射特性等,因此對于數據的上述特性的分析和表達是構建有效模型的基礎。Kusk 等人(2016)和 Hansen 等人(2017)通過對 SAR 成像時地形、回波噪聲等要素進行建模,實現基于 3DCAD 對不同類型地物要素的 SAR 圖像仿真。Yan等(2019)通過對艦船等目標進行三維模型構建,從而生成仿真的目標點云數據。Ma 等(2019a)提出了一種包含生成和判別結構的網絡模型,通過對抗學習實現樣本表觀真實性的增強。Zhan 等(2017)和 Zhu 等(2018)提出了一種針對高光譜影像分類的生成對抗網絡模型。Zhang 等(2018b)設計出一種基于條件模型的生成對抗網絡,用于遙感圖像中飛機目標的精細仿真。Yan 等人(2019)則基于點云數據在三維空間上進行船舶模型構建,并利用正射投影變換將模型從模型空間投影至海岸遙感圖像上進行仿真數據生成。為了進一步提升仿真對象和遙感背景間的適配性,Wang 等人(2020b)則進一步提出利用 CycleGAN 對仿真的飛機目標和背景進行自適應調整,設計了一種用于目標檢測任務的建模仿真數據生成框架。在地物要素分類任務上,Kong 等人(2020)則利用 CityEngine 仿真平臺的批量建模特性,首次探索在廣域范圍內進行城市級別的場景建模,并發布了一套用于建筑物分割的遙感仿真數據集 Synthinel-1。面向遙感數據特點的專用網絡模型設計方面,主要結合遙感圖像中目標旋轉、多尺度、目標分布特性等特點,針對性設計網絡結構來提升專用模型性能。Zhou 等(2018)設計了一種源域到目標域數據共現特征聚焦結構,提升高光譜圖像的語義分割效果。Luo 等(2018)針對高光譜圖像語義分割中存在的類內特征分布差異,提出了一種均值差異最大化約束模型。Rao 等(2019)設計了一種自適應距離度量模型,提升高光譜圖像地物要素的分類精度。Kampffmeyer 等(2016)針對地物要素數量、空間分布差異大的問題,提出了一種結合區域分組與像素分組的模型訓練策略,用于國土資源監測任務。Liu 等(2017)針對遙感目標尺度差異大的特點,提出基于沙漏網絡的多尺度特征增強模型,提升光學遙感圖像的分類精度。Marcos 等人(2018)提出了基于旋轉卷積構建的多源數據提取網絡,通過編碼圖像的旋轉不變性特征在多個數據集取得了先進的結果。Peng 等人(2020)基于注意機制和密集連接網絡有效融合 DSM 數據和光譜圖像并獲得了更好的分割效果。Hua 等人(2021)提出了特征和空間關系調節網絡,利用稀疏注釋,基于無監督的學習信號來補充監督任務,顯著提升了語義分割的性能。隨著遙感圖像分辨率的提升、網絡深度的增加、參數的堆疊帶來性能的提升,與之相伴的是龐大的模型、巨量的參數和緩慢的算法效率。考慮到星上遙感數據實時處理對計算資源、存儲資源的限制,一些工作嘗試在保留算法高性能前提下,減少模型參數,提高算法運算速度。Valada 等人(2019)利用分組卷積的設計思想提出了一種高效的帶孔空間金字塔池化結構,用于高分辨遙感圖像地物要素提取。提出的方法能夠減少 87.87%的參數量,減少89.88%每秒浮點運算次數(floating-point operationsper second, FLOPS)。Zhang 等人(2019b)基于深度可分卷積設計了一種面向合成孔徑雷達圖像的船舶檢測算法的特征提取網絡,大大提升了檢測速度,相比于輕量化前的網絡檢測速度提高了 2.7 倍。Cao等人(2019)利用深度可分卷積設計了一種用于提取數字表面模型數據的結構,該網絡結構無需預訓練模型仍可以快速收斂,將網絡訓練時間降低 50%以上。Wang 等人(2019b)提出一種輕量級網絡MFNet,實現對高分辨率航拍數據的地物要素分類任務的高效推理,相比于輕量級網絡 ResNet-18,提出的網絡在分類精度提升的同時,將參數量減少了40%,推理速度提高了 27%。Ma 等人(2020)針對災后損毀評估任務,以 ShuffleNet v2 模型為基礎,設計了一種輕量化建筑物提取模型,相比傳統模型,在精度提升 5.24%的同時,速度提高 5.21f/s。上述方法通過結合遙感目標要素特點,通過提出專用網絡結構或特征提取方法,提升傳統模型針對遙感數據的應用能力。然而,對于不同類型數據、不同特征/特性,仍缺乏統一的網絡結構進行表征,因此多要素信息多任務并行網絡和模型仍需進一步研究。

1.3.2多要素信息并行提取

多要素信息并行提取方法的研究,主要集中于探索如何在一個統一模型中實現多類遙感地物要素目標的類別、位置等屬性信息的高精度獲取。如前所述,針對這種典型的“多輸入多輸出”場景,現有方法重點針對多模態輸入數據的特征表示和多任務輸出特征的共享融合兩方面問題開展研究。特征共享研究方面,根據模型共享參數實現方式的區別,現有方法可大致分為硬參數共享( hard-parameter sharing ) 和軟參數共享(soft-parameter sharing)兩種。硬參數共享方法利用同一個模型實現在輸入和輸出端的多任務分支模型特征共享融合。Liebel 等(2020)面向城市建設狀況分析任務,將多個任務共享同一編碼器,并分別解碼輸出,實現同時輸出建筑物位置和深度信息。Papadomanolaki 等(2019)將地物要素重建模型融合到分類模型中,并約束分類模型訓練,來提升分類效果。Khalel 等(2019)則在同一個網絡模型中同時嵌入圖像銳化與地物要素分類兩類任務的模型。Rosa 等(2020)設計了一種面向農業生產狀況監控的多任務全卷積回歸網絡。軟參數共享方法直接將針對不同任務的多個獨立網絡通過參數加權連接,實現多類任務的共享輸出。Volpi 等(2018)將條件隨機場擬合結果與圖像同時作為數據,構建類內相似度和邊界值預測的兩個分支模型,改善地物要素分類結果。Zhang 等(2019a)提出了面向極化 SAR 多通道數據的地物要素分類方法,利用獨立的特征提取網絡對幅值和相位信息分別建模,利用分類器進行聯合約束訓練,來提升精度。Shi 等(2020)針對高光譜圖像的多類要素分類任務,利用多任務集成學習實現通道選擇,獲取最優通道組合。針對多模態數據的聯合特征表示,如圖像紋理特征、三維高程特征、目標要素矢量拓撲特征等,能有效提升各類任務的性能。Chen 等(2019)針對洪災區域檢測任務,提出融合多時相的多模態圖像的模型,來提升其檢測精度。Fernandez 等(2018)將SAR 圖像和多光譜圖像作為輸入,進行無監督的地物要素分類。Benson 等(2017)在森林冠層三維高度估計任務中,提出利用光譜特性數據的方法,能有效改善傳統三維估計方法的精度。

審核編輯 黃昊宇

電子發燒友App

電子發燒友App

評論