大家好,我是花哥。

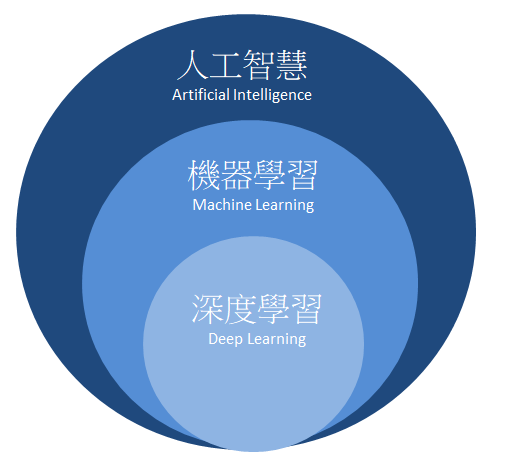

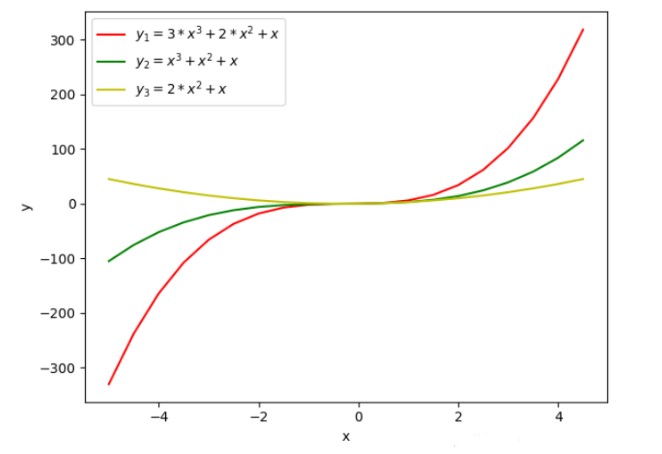

通俗來說,機器學習模型就是一種數學函數,它能夠將輸入數據映射到預測輸出。更具體地說,機器學習模型就是一種通過學習訓練數據,來調整模型參數,以最小化預測輸出與真實標簽之間的誤差的數學函數。

機器學習中的模型有很多種,例如邏輯回歸模型、決策樹模型、支持向量機模型等,每一種模型都有其適用的數據類型和問題類型。同時,不同模型之間存在著許多共性,或者說有一條隱藏的模型演化的路徑。

以聯結主義的感知機為例,通過增加感知機的隱藏層數,我們可以將其轉化為深度神經網絡。而對感知機加入核函數就可以轉化為SVM。這一過程可以直觀地展示了不同模型之間的內在聯系,以及模型間的轉化可能。按照相似點,我粗糙(不嚴謹)地將模型分為如下6個大類,以方便發現基礎的共性,逐個深入剖析!

一、神經網絡(聯結主義)類的模型:?

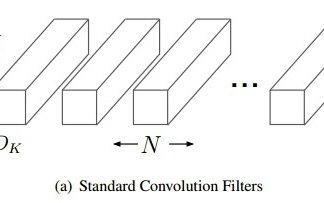

聯結主義類模型是一種模擬人腦神經網絡結構和功能的計算模型。其基本單元是神經元,每個神經元接收來自其他神經元的輸入,通過調整權重來改變輸入對神經元的影響。神經網絡是一個黑箱子,通過多層的非線性隱藏層的作用,可以達到萬能近似的效果。

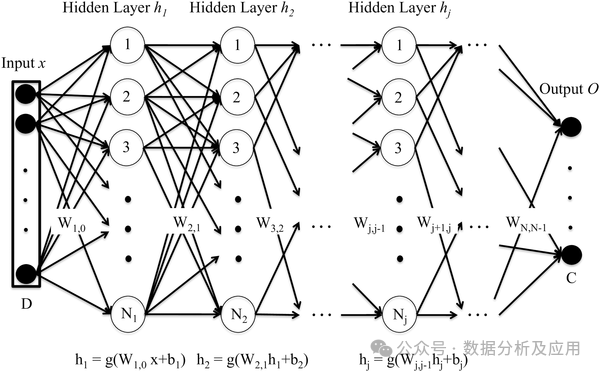

代表模型有DNN、SVM、Transformer、LSTM,某些情況下,深度神經網絡的最后一層可以看作是一個邏輯回歸模型,用于對輸入數據進行分類。而支持向量機也可以看作是特殊類型的神經網絡,其中只有兩層:輸入層和輸出層,SVM額外地通過核函數實現復雜的非線性轉化,達到和深度神經網絡類似的效果。如下為經典DNN模型原理解析:

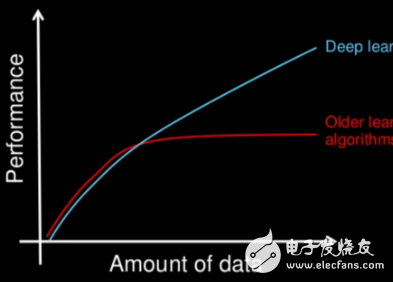

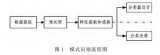

深度神經網絡(Deep Neural Network,DNN)由多層神經元組成,通過前向傳播過程,將輸入數據傳遞到每一層神經元,經過逐層計算得到輸出。每一層神經元都會接收上一層神經元的輸出作為輸入,并輸出到下一層神經元。DNN的訓練過程是通過反向傳播算法實現的。在訓練過程中,計算輸出層與真實標簽之間的誤差,并將誤差反向傳播到每一層神經元,根據梯度下降算法更新神經元的權重和偏置項。通過反復迭代這個過程,不斷優化網絡參數,最終使得網絡的預測誤差最小化。

DNN的優點是強大的特征學習能力:DNN可以自動學習數據的特征,無需手動設計特征。高度非線性及強大的泛化能力。缺點是DNN需要大量的參數,這可能導致過擬合問題。同時DNN的計算量很大,訓練時間長。且模型解釋性較弱。以下是一個簡單的Python代碼示例,使用Keras庫構建一個深度神經網絡模型:

?

?

from keras.models import Sequential from keras.layers import Dense from keras.optimizers import Adam from keras.losses import BinaryCrossentropy import numpy as np # 構建模型 model = Sequential() model.add(Dense(64, activation='relu', input_shape=(10,))) # 輸入層有10個特征 model.add(Dense(64, activation='relu')) # 隱藏層有64個神經元 model.add(Dense(1, activation='sigmoid')) # 輸出層有1個神經元,使用sigmoid激活函數進行二分類任務 # 編譯模型 model.compile(optimizer=Adam(lr=0.001), loss=BinaryCrossentropy(), metrics=['accuracy']) # 生成模擬數據集 x_train = np.random.rand(1000, 10) # 1000個樣本,每個樣本有10個特征 y_train = np.random.randint(2, size=1000) # 1000個標簽,二分類任務 # 訓練模型 model.fit(x_train, y_train, epochs=10, batch_size=32) # 訓練10個輪次,每次使用32個樣本進行訓練

?

?

二、符號主義類的模型

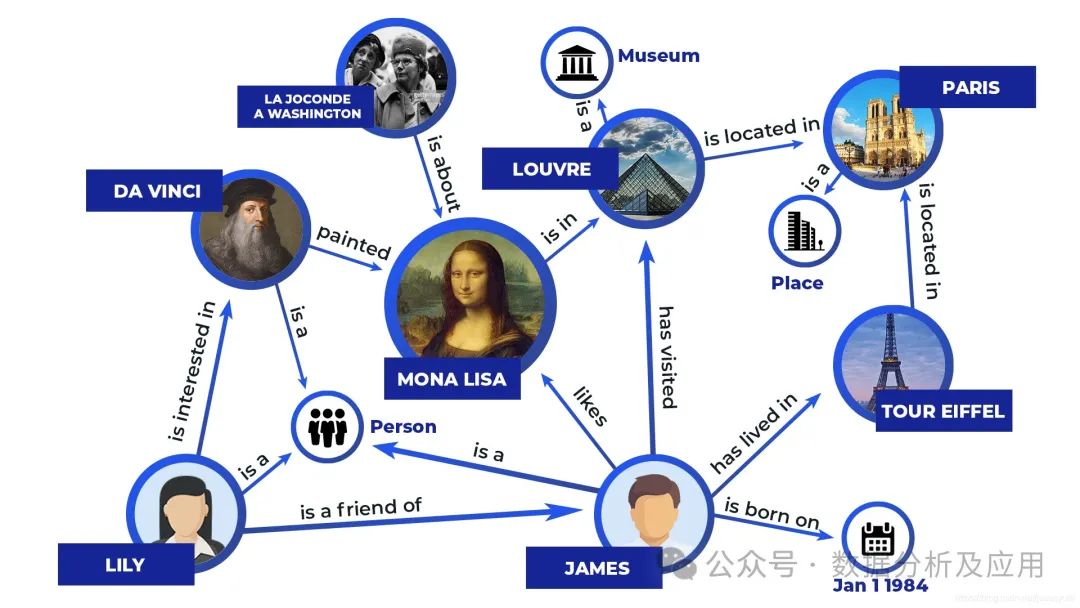

符號主義類的模型是一種基于邏輯推理的智能模擬方法,其認為人類是一個物理符號系統,計算機也是一個物理符號系統,因此,就可以用計算機的規則庫和推理引擎來來模擬人的智能行為,即用計算機的符號操作來模擬人的認知過程(說白了,就是將人類邏輯存入計算機,達成智能執行)。

其代表模型有專家系統、知識庫、知識圖譜,其原理是將信息編碼成一組可識別的符號,通過顯式的規則來操作符號以產生運算結果。如下專家系統的簡單示例:

?

?

# 定義規則庫

rules = [

{"name": "rule1", "condition": "sym1 == 'A' and sym2 == 'B'", "action": "result = 'C'"},

{"name": "rule2", "condition": "sym1 == 'B' and sym2 == 'C'", "action": "result = 'D'"},

{"name": "rule3", "condition": "sym1 == 'A' or sym2 == 'B'", "action": "result = 'E'"},

]

# 定義推理引擎

def infer(rules, sym1, sym2):

for rule in rules:

if rule["condition"] == True: # 條件為真時執行動作

return rule["action"]

return None # 沒有滿足條件的規則時返回None

# 測試專家系統

print(infer(rules, 'A', 'B')) # 輸出: C

print(infer(rules, 'B', 'C')) # 輸出: D

print(infer(rules, 'A', 'C')) # 輸出: E

print(infer(rules, 'B', 'B')) # 輸出: E

?

?

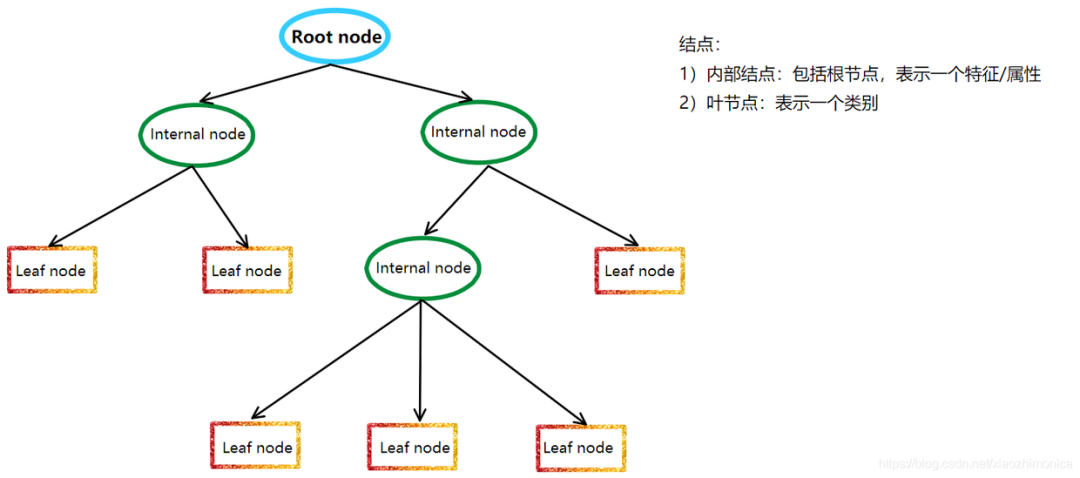

三、決策樹類的模型

決策樹模型是一種非參數的分類和回歸方法,它利用樹形圖表示決策過程。更通俗來講,樹模型的數學描述就是“分段函數”。它利用信息論中的熵理論選擇決策樹的最佳劃分屬性,以構建出一棵具有最佳分類性能的決策樹。

決策樹模型的基本原理是遞歸地將數據集劃分成若干個子數據集,直到每個子數據集都屬于同一類別或者滿足某個停止條件。在劃分過程中,決策樹模型采用信息增益、信息增益率、基尼指數等指標來評估劃分的好壞,以選擇最佳的劃分屬性。

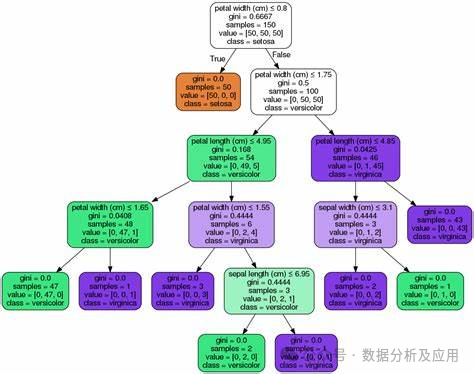

決策樹模型的代表模型有很多,其中最著名的有ID3、C4.5、CART等。ID3算法是決策樹算法的鼻祖,它采用信息增益來選擇最佳劃分屬性;C4.5算法是ID3算法的改進版,它采用信息增益率來選擇最佳劃分屬性,同時采用剪枝策略來提高決策樹的泛化能力;CART算法則是分類和回歸樹的簡稱,它采用基尼指數來選擇最佳劃分屬性,并能夠處理連續屬性和有序屬性。

以下是使用Python中的Scikit-learn庫實現CART算法的代碼示例:

?

?

from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split from sklearn.tree import DecisionTreeClassifier, plot_tree # 加載數據集 iris = load_iris() X = iris.data y = iris.target # 劃分訓練集和測試集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 構建決策樹模型 clf = DecisionTreeClassifier(criterion='gini') clf.fit(X_train, y_train) # 預測測試集結果 y_pred = clf.predict(X_test) # 可視化決策樹 plot_tree(clf)

?

?

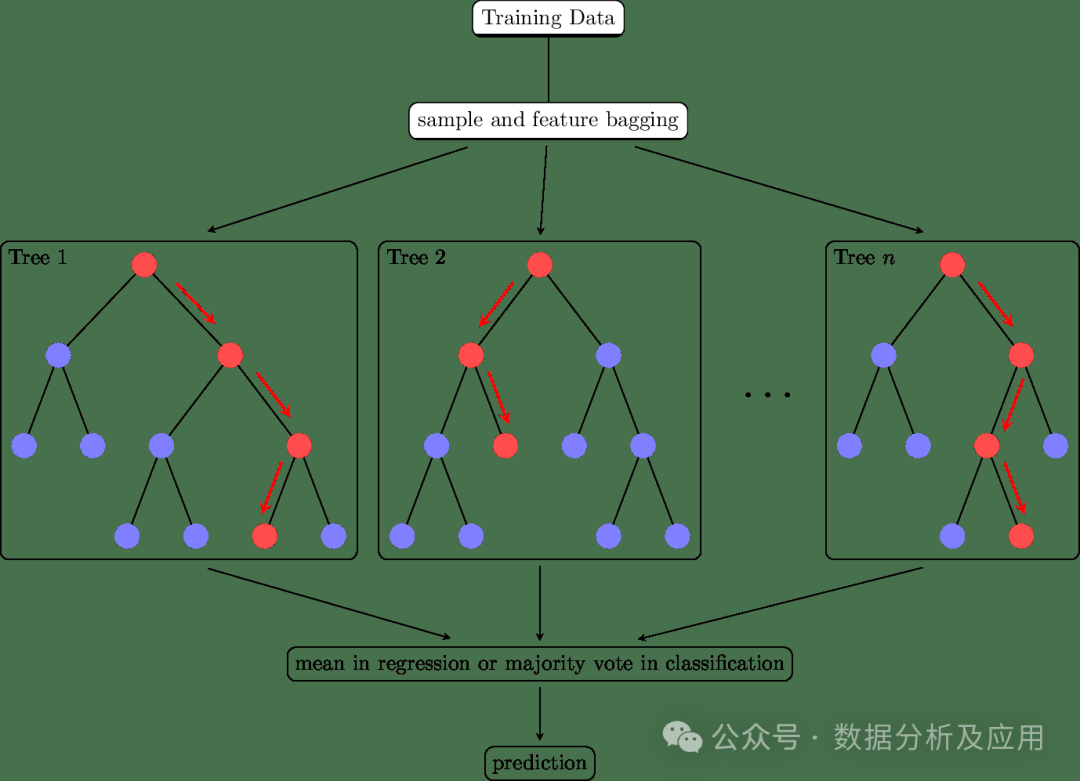

四、概率類的模型

概率模型是一種基于概率論的數學模型,用于描述隨機現象或事件的分布、發生概率以及它們之間的概率關系。概率模型在各個領域都有廣泛的應用,如統計學、經濟學、機器學習等。

概率模型的原理基于概率論和統計學的基本原理。它使用概率分布來描述隨機變量的分布情況,并使用概率規則來描述事件之間的條件關系。通過這些原理,概率模型可以對隨機現象或事件進行定量分析和預測。

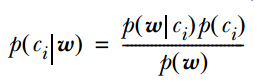

代表模型主要有:樸素貝葉斯分類器、貝葉斯網絡、隱馬爾可夫模型。其中,樸素貝葉斯分類器和邏輯回歸都基于貝葉斯定理,它們都使用概率來表示分類的不確定性。

隱馬爾可夫模型和貝葉斯網絡都是基于概率的模型,可用于描述隨機序列和隨機變量之間的關系。

樸素貝葉斯分類器和貝葉斯網絡都是基于概率的圖模型,可用于描述隨機變量之間的概率關系。

以下是使用Python中的Scikit-learn庫實現樸素貝葉斯分類器的代碼示例:

?

?

from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split from sklearn.naive_bayes import GaussianNB # 加載數據集 iris = load_iris() X = iris.data y = iris.target # 劃分訓練集和測試集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 構建樸素貝葉斯分類器模型 clf = GaussianNB() clf.fit(X_train, y_train) # 預測測試集結果 y_pred = clf.predict(X_test)

?

?

五、近鄰類的模型

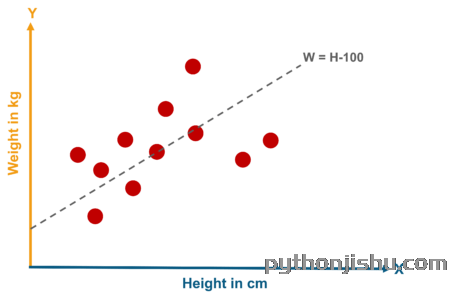

近鄰類模型(本來想命名為距離類模型,但是距離類的定義就比較寬泛了)是一種非參數的分類和回歸方法,它基于實例的學習不需要明確的訓練和測試集的劃分。它通過測量不同數據點之間的距離來決定數據的相似性。

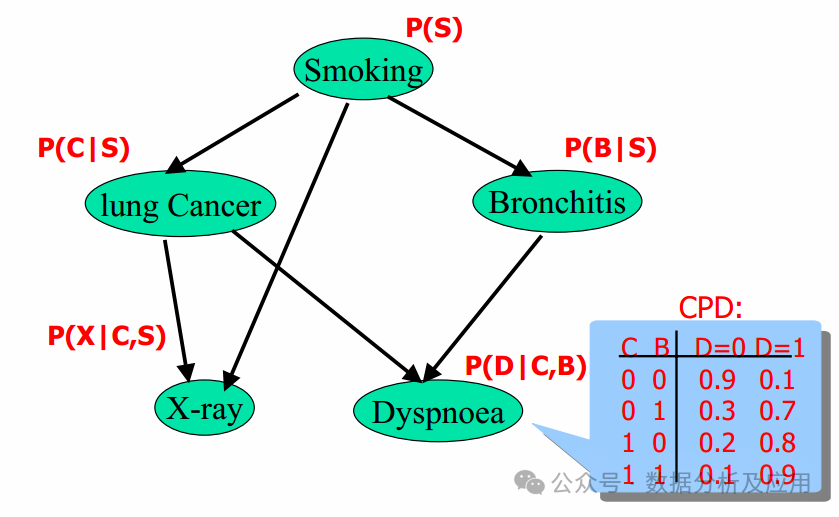

以KNN算法為例,其核心思想是,如果一個樣本在特征空間中的 k 個最接近的訓練樣本中的大多數屬于某一個類別,則該樣本也屬于這個類別。KNN算法基于實例的學習不需要明確的訓練和測試集的劃分,而是通過測量不同數據點之間的距離來決定數據的相似性。

代表模型有:k-近鄰算法(k-Nearest Neighbors,KNN)、半徑搜索(Radius Search)、K-means、權重KNN、多級分類KNN(Multi-level Classification KNN)、近似最近鄰算法(Approximate Nearest Neighbor, ANN)

近鄰模型基于相似的原理,即通過測量不同數據點之間的距離來決定數據的相似性。

除了最基礎的KNN算法外,其他變種如權重KNN和多級分類KNN都在基礎算法上進行了改進,以更好地適應不同的分類問題。

近似最近鄰算法(ANN)是一種通過犧牲精度來換取時間和空間的方式,從大量樣本中獲取最近鄰的方法。ANN算法通過降低存儲空間和提高查找效率來處理大規模數據集。它通過“近似”的方法來減少搜索時間,這種方法允許在搜索過程中存在少量誤差。

以下是使用Python中的Scikit-learn庫實現KNN算法的代碼示例:

?

?

from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split from sklearn.neighbors import KNeighborsClassifier # 加載數據集 iris = load_iris() X = iris.data y = iris.target # 劃分訓練集和測試集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 構建KNN分類器模型 knn = KNeighborsClassifier(n_neighbors=3) knn.fit(X_train, y_train) # 預測測試集結果 y_pred = knn.predict(X_test)

?

?

六、集成學習類的模型

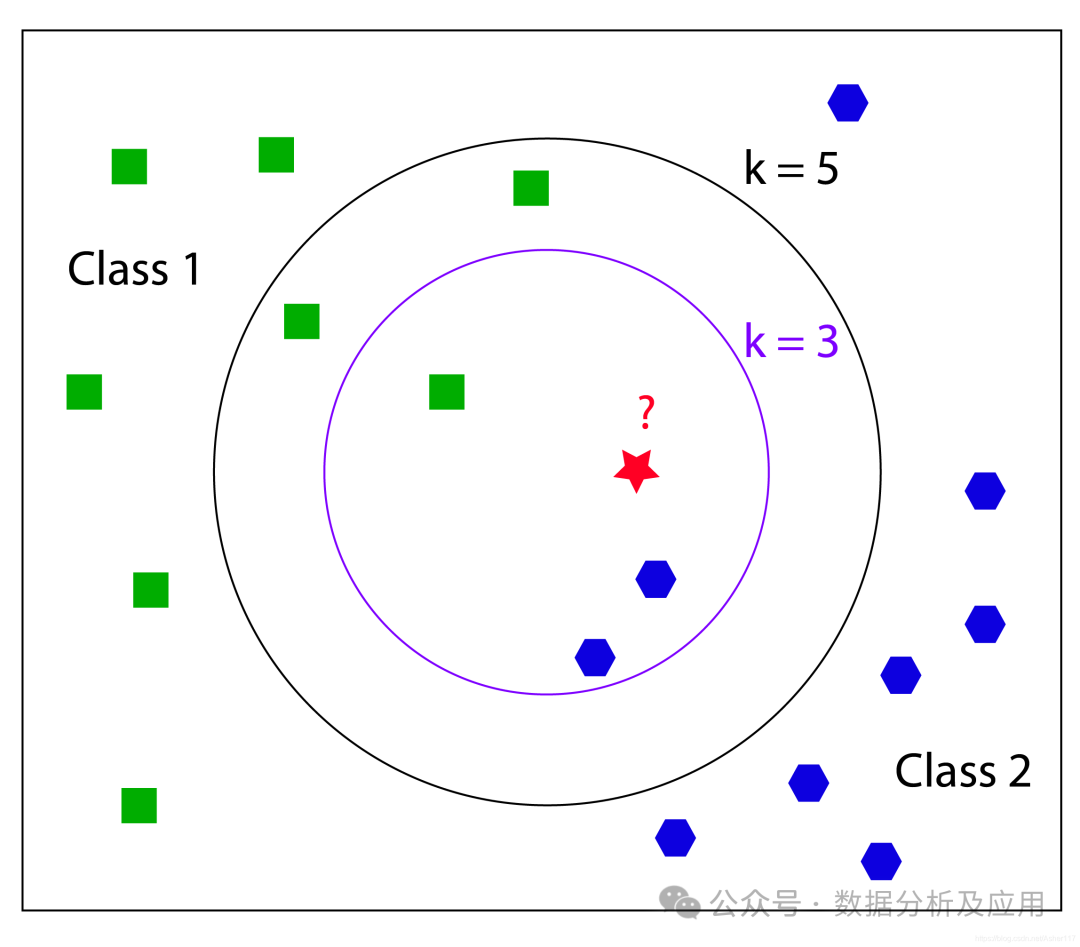

集成學習(Ensemble Learning)不僅僅是一類的模型,更是一種多模型融合的思想,通過將多個學習器的預測結果進行合并,以提高整體的預測精度和穩定性。在實際應用中,集成學習無疑是數據挖掘的神器!

集成學習的核心思想是通過集成多個基學習器來提高整體的預測性能。具體來說,通過將多個學習器的預測結果進行合并,可以減少單一學習器的過擬合和欠擬合問題,提高模型的泛化能力。同時,通過引入多樣性(如不同的基學習器、不同的訓練數據等),可以進一步提高模型的性能。常用的集成學習方法有:

Bagging是一種通過引入多樣性和減少方差來提高模型穩定性和泛化能力的集成學習方法。它可以應用于任何分類或回歸算法。

Boosting是一種通過引入多樣性和改變基學習器的重要性來提高模型性能的集成學習方法。它也是一種可以應用于任何分類或回歸算法的通用技術。

stack堆疊是一種更高級的集成學習方法,它將不同的基學習器組合成一個層次結構,并通過一個元學習器對它們進行整合。堆疊可以用于分類或回歸問題,并通常用于提高模型的泛化能力。

集成學習代表模型有:隨機森林、孤立森林、GBDT、Adaboost、Xgboost等。以下是使用Python中的Scikit-learn庫實現隨機森林算法的代碼示例:

?

?

from sklearn.ensemble import RandomForestClassifier from sklearn.datasets import load_iris from sklearn.model_selection import train_test_split # 加載數據集 iris = load_iris() X = iris.data y = iris.target # 劃分訓練集和測試集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 構建隨機森林分類器模型 clf = RandomForestClassifier(n_estimators=100, random_state=42) clf.fit(X_train, y_train) # 預測測試集結果 y_pred = clf.predict(X_test)

?

?

綜上,我們通過將相似原理的模型歸納為各種類別,以此逐個類別地探索其原理,可以更為系統全面地了解模型的原理及聯系。

審核編輯:黃飛

?

電子發燒友App

電子發燒友App

評論