AI的訓(xùn)練和推理共同鑄就了其無與倫比的處理能力。在AI訓(xùn)練方面,GPU因其出色的并行計(jì)算能力贏得了業(yè)界的青睞,成為了當(dāng)前AI大模型最熱門的芯片;而在 AI 推理方面,具備卓越通用性和靈活性的CPU本應(yīng)發(fā)揮關(guān)鍵作用,但其重要性卻常常被忽視。

“對于那些希望將大語言模型(LLM)集成到產(chǎn)品和服務(wù)中的企業(yè)和開發(fā)者來說,CPU 通常是首選”。Arm 中國區(qū)業(yè)務(wù)全球副總裁鄒挺在接受采訪時表示。為了適應(yīng)AI推理的應(yīng)用落地,CPU有針對性的優(yōu)化必不可少,Arm Neoverse平臺通過增加如SVE2指令集使得AI 推理具有更好的性能和效率。

Arm中國區(qū)業(yè)務(wù)全球副總裁 鄒挺

CPU對于AI推理的重要性

CPU長期以來廣泛應(yīng)用于傳統(tǒng)的AI和機(jī)器學(xué)習(xí)任務(wù),其通用性和靈活性使其在部署AI推理時更具優(yōu)勢。鄒挺表示,在AI場景落地初期,專用AI處理器的開發(fā)周期較長,因此,高能效CPU 自然成為了推理的核心;隨著 AI 技術(shù)的深入發(fā)展和應(yīng)用場景的多樣化,定制化專用 AI 加速器應(yīng)運(yùn)而生。在這一過程中,高能效的CPU不僅作為核心控制單元,還與 GPU、NPU、FPGA、ASIC 等異構(gòu)單元協(xié)同工作,管理和調(diào)度系統(tǒng)資源,成為AI推理的“靈魂捕手”。

相比于單純依賴 GPU 的高成本和高功耗,CPU在推理過程中具有更高的能效比。CPU 的設(shè)計(jì)更適合處理多任務(wù)負(fù)載,并且無需復(fù)雜的冷卻和電力解決方案。這使得CPU在大規(guī)模部署中能夠以更低的成本運(yùn)行,特別是在資源受限的環(huán)境中,其低功耗的特性尤為顯著。這對于那些需要長期、穩(wěn)定運(yùn)行的 AI 應(yīng)用來說,是一個可持續(xù)且經(jīng)濟(jì)高效的選擇。

Arm Neoverse平臺集成SVE2技術(shù),對AI計(jì)算至關(guān)重要

Arm Neoverse CPU在 AI 推理中展現(xiàn)了其獨(dú)特優(yōu)勢,這一點(diǎn)要從其技術(shù)底層開始剖析。

鄒挺分析,Armv9架構(gòu)已經(jīng)引入 Arm Neoverse 平臺,在Armv9架構(gòu)中Arm 集成SVE2(可擴(kuò)展向量擴(kuò)展)指令集。SVE2 作為一種可擴(kuò)展的向量處理技術(shù),允許處理器同時執(zhí)行多個數(shù)據(jù)元素操作,從而提供了更高效的向量計(jì)算和AI 硬件加速。

SVE2 在AI推理中的一個關(guān)鍵應(yīng)用是矩陣運(yùn)算。矩陣乘法是許多AI任務(wù)中的常見計(jì)算,而 SVE2 向量指令可以同時處理多個數(shù)據(jù)元素,使矩陣乘法能夠以向量化的方式進(jìn)行,從而提高了計(jì)算效率。

例如,SVE2 中的 FMMLA 指令可以實(shí)現(xiàn) FP32 格式下的矩陣乘法,BFMMLA 指令能夠在 BF16 格式下進(jìn)行高效運(yùn)算,而 UMMLA、SMMLA 等指令則優(yōu)化了 INT8 格式下的矩陣運(yùn)算。通過這些指令和硬件加速功能,AI 推理在Arm架構(gòu)上能夠?qū)崿F(xiàn)更高效的矩陣運(yùn)算和更優(yōu)的能效比。

這種技術(shù)不僅提升了 AI 推理中矢量運(yùn)算的效率,尤其是在深度學(xué)習(xí)和自然語言處理(NLP)等核心任務(wù)上,加快了推理速度,并在能效表現(xiàn)上進(jìn)行了優(yōu)化。通過 SVE2 的支持,Arm Neoverse CPU 可以在邊緣計(jì)算和資源受限的環(huán)境中高效運(yùn)行,從而減少對 GPU 和其他硬件資源的依賴。

基于Arm Neoverse的CPU顯著提升推理性能

亞馬遜云服務(wù)(AWS)、微軟、Google和甲骨文 (Oracle) 等全球最大的 AI 頭部云服務(wù)提供商們都通過 Arm Neoverse 進(jìn)行通用計(jì)算和基于 CPU 的 AI 推理與訓(xùn)練。Arm Neoverse 不僅為這些頭部云服務(wù)商提供了定制芯片的靈活性,還優(yōu)化了嚴(yán)苛的工作負(fù)載,確保在每瓦功率的使用上實(shí)現(xiàn)更高的計(jì)算效率。

例如,基于Arm架構(gòu)的AWS Graviton,與其他同行業(yè)產(chǎn)品相比,Amazon Sagemaker 的 AI 推理性能提高了 25%,Web 應(yīng)用程序提高了 30%,數(shù)據(jù)庫提高了 40%,效率則提升了 60%。基于 Arm 架構(gòu)的 Google Cloud Axion,與傳統(tǒng)架構(gòu)相比,其性能和能效分別提高了 50% 和 60%,可為基于 CPU 的 AI 推理和訓(xùn)練、YouTube、Google 地球等服務(wù)提供支持。

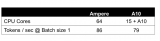

基于 Arm Neoverse N2 架構(gòu)的阿里云倚天 710,在運(yùn)行 Llama 3 和 Qwen1.5 等業(yè)內(nèi)標(biāo)準(zhǔn)大語言模型時展現(xiàn)了極高的靈活性和擴(kuò)展性。通過與 Arm 軟件團(tuán)隊(duì)的緊密合作,阿里云對 llama.cpp 中的 int4 和 int8 GEMM 內(nèi)核進(jìn)行了優(yōu)化,特別是利用了 SMMLA 指令來提高計(jì)算效率。在 ecs.g8y.16xlarge 實(shí)例上(配置64個 vCPU 和 256GB 內(nèi)存),多次實(shí)驗(yàn)結(jié)果顯示,每秒處理的詞元數(shù)量增加了 2.7 倍。此外,詞元生成的吞吐量在處理更大批次數(shù)據(jù)時最多提高了 1.9 倍。詞元生成的延遲對于交互式 LLM 部署非常關(guān)鍵。實(shí)驗(yàn)表明,阿里云倚天 710 在單次操作和批量處理場景下均能保持 100 毫秒以內(nèi)的延遲目標(biāo),這符合人們每秒 5-10 個單詞的典型閱讀速度。因此,這一架構(gòu)非常適合常規(guī)體量的 LLM 部署。

與其他服務(wù)器 CPU 的對比中,阿里云倚天 710 的優(yōu)勢顯著。在與 Intel Icelake 和 Sapphire Rapids 的對比中,倚天 710 在提示詞處理性能上提升了 3.2 倍,詞元生成性能則提升了 2.2 倍。這表明,倚天 710 不僅在處理性能上有明顯優(yōu)勢,其成本效益也極具吸引力,成為了 LLM 推理應(yīng)用中的理想選擇。

小模型的推理優(yōu)化

越來越多的企業(yè)將開發(fā)重心轉(zhuǎn)向小語言模型(Small Language Models, SLM)或小型 LLM,小模型尤其是在處理對話、翻譯、摘要、分類等任務(wù)時,效率更高且耗能更少。與需要高昂的基礎(chǔ)設(shè)施成本和復(fù)雜漫長的開發(fā)部署周期的大語言模型相比,這些模型在訓(xùn)練過程中消耗的電力也相對較低,適合更靈活、可定制的應(yīng)用場景。

鄒挺分析,在提升模型效率方面,量化技術(shù)是一個重要的優(yōu)化手段。通過將神經(jīng)網(wǎng)絡(luò)的權(quán)重降低到更低的精度,量化技術(shù)顯著減少了模型的內(nèi)存和計(jì)算需求。比如,將16位浮點(diǎn)數(shù)壓縮為4位整數(shù),可以大幅降低內(nèi)存占用和計(jì)算成本,同時對精度的影響微乎其微。

以 Llama 2 模型為例,原本擁有 70 億參數(shù)的模型在量化后,從 13.5 GB 縮減至 3.9 GB;130 億參數(shù)的版本從 26.1 GB 縮減至7.3 GB;而700 億參數(shù)模型則從 138 GB 減少至 40.7 GB。這些優(yōu)化顯著提升了模型的運(yùn)行速度,同時降低了在 CPU 上運(yùn)行的成本。

結(jié)合高效的 Arm CPU 技術(shù),這些優(yōu)化讓輕量級模型可以直接在移動設(shè)備上運(yùn)行,不僅提升了性能,還實(shí)現(xiàn)了數(shù)據(jù)隱私保護(hù)和用戶體驗(yàn)的優(yōu)化。

他進(jìn)一步表示,在針對 FunASR 語音識別模型的優(yōu)化方面,Arm 充分利用了Armv9 架構(gòu)中的 SVE2 指令、BF16 數(shù)據(jù)類型等特性,并引入了動態(tài)量化技術(shù),使得 FunASR 模型在 Arm Neoverse 服務(wù)器上實(shí)現(xiàn)了高效運(yùn)行。FunASR 是阿里巴巴達(dá)摩院開發(fā)的開源大模型,基于 Paraformer 架構(gòu),具備語音識別、語音端點(diǎn)檢測、標(biāo)點(diǎn)恢復(fù)、語言模型、說話人驗(yàn)證和分離等多種功能。

SVE2 指令集在Arm架構(gòu)處理器中,對 INT8 數(shù)據(jù)的并行處理非常高效,一次指令周期可以完成 16 個 INT8 的乘累加操作。因此,在對模型執(zhí)行效率有更高要求的場景下,可以采用 INT8 動態(tài)量化來提升效率。此外,INT8 和 BF16 的數(shù)據(jù)格式組合也進(jìn)一步優(yōu)化了模型計(jì)算效率,在保持精度的前提下,實(shí)現(xiàn)了 1. 5 倍的效率提升。這樣的優(yōu)化確保了 FunASR 等大模型在 Arm 架構(gòu)上的高效運(yùn)行,使其能夠在特定領(lǐng)域 AI 應(yīng)用中發(fā)揮重要作用。

不斷優(yōu)化AI推理的性能與能耗

當(dāng)前全球數(shù)據(jù)中心每年消耗約460太瓦時的電力,隨著AI技術(shù)和應(yīng)用的快速發(fā)展,這一數(shù)字預(yù)計(jì)在2030年將增長至當(dāng)前的三倍。目前,數(shù)據(jù)中心中約有85%的AI負(fù)載用于推理任務(wù),這些任務(wù)涵蓋了眾多應(yīng)用和設(shè)備。

Arm Neoverse的架構(gòu)不僅提升了云端計(jì)算的性能和能效,還為大規(guī)模云服務(wù)提供商和數(shù)據(jù)中心優(yōu)化了TCO。例如,基于Arm Neoverse 平臺的 AWS Graviton3 在AI推理過程中節(jié)約了50%的成本。

據(jù)悉,Arm在Neoverse的產(chǎn)品線目前有V、N、E三個平臺系列,其中Neoverse V與Neoverse N又進(jìn)一步推出計(jì)算子系統(tǒng)CSS產(chǎn)品,為想快速推出產(chǎn)品,掌握人工智能機(jī)遇的合作伙伴,縮減產(chǎn)品開發(fā)時間,加速產(chǎn)品上市進(jìn)程。

迄今為止,合作伙伴基于Arm架構(gòu)的芯片出貨量已達(dá)到 3,000 億顆,這一龐大的市場基礎(chǔ)使Arm能夠支持各種AI 技術(shù)領(lǐng)域的發(fā)展,并成為推動AI創(chuàng)新的重要平臺。AI 推理正從集中在云端擴(kuò)展到更多的邊緣應(yīng)用,以實(shí)現(xiàn)更廣泛的覆蓋和更高效的響應(yīng)。

鄒挺說道: “從移動設(shè)備到 AI 領(lǐng)域,高性能和出色能效始終是Arm的DNA。Arm 將繼續(xù)推動 AI 的技術(shù)變革,帶來更高效、更可持續(xù)的計(jì)算解決方案,確保我們的技術(shù)能夠支持合作伙伴在 AI 時代的多樣化需求,同時推動 AI 技術(shù)在更多領(lǐng)域的廣泛落地和普及。”

-

ARM

+關(guān)注

關(guān)注

134文章

9322瀏覽量

375599

發(fā)布評論請先 登錄

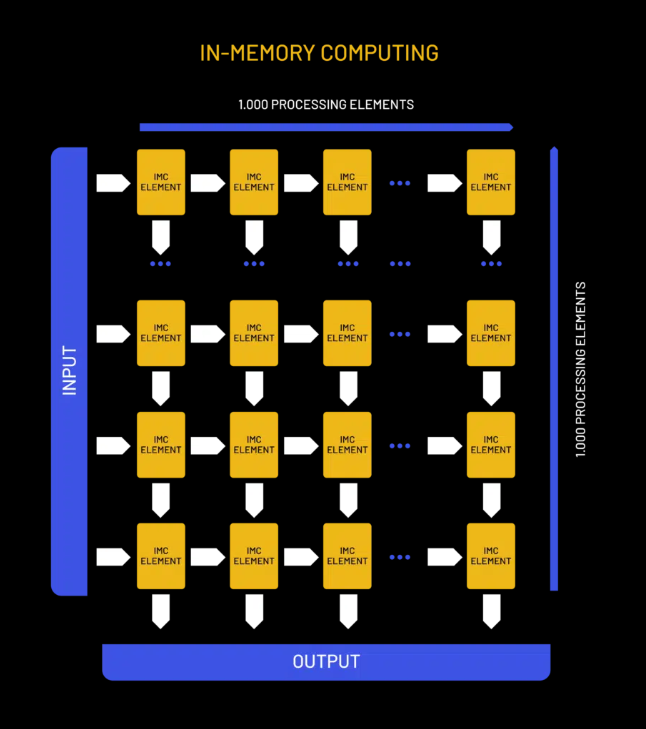

AI推理的存儲,看好SRAM?

Arm CPU適配通義千問Qwen3系列模型

谷歌新一代 TPU 芯片 Ironwood:助力大規(guī)模思考與推理的 AI 模型新引擎?

AI大模型在汽車應(yīng)用中的推理、降本與可解釋性研究

Arm技術(shù)助力Google Axion處理器加速AI工作負(fù)載推理

Arm成功將Arm KleidiAI軟件庫集成到騰訊自研的Angel 機(jī)器學(xué)習(xí)框架

CPU推理:AI算力配置新范式

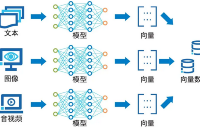

高效大模型的推理綜述

李開復(fù):中國擅長打造經(jīng)濟(jì)實(shí)惠的AI推理引擎

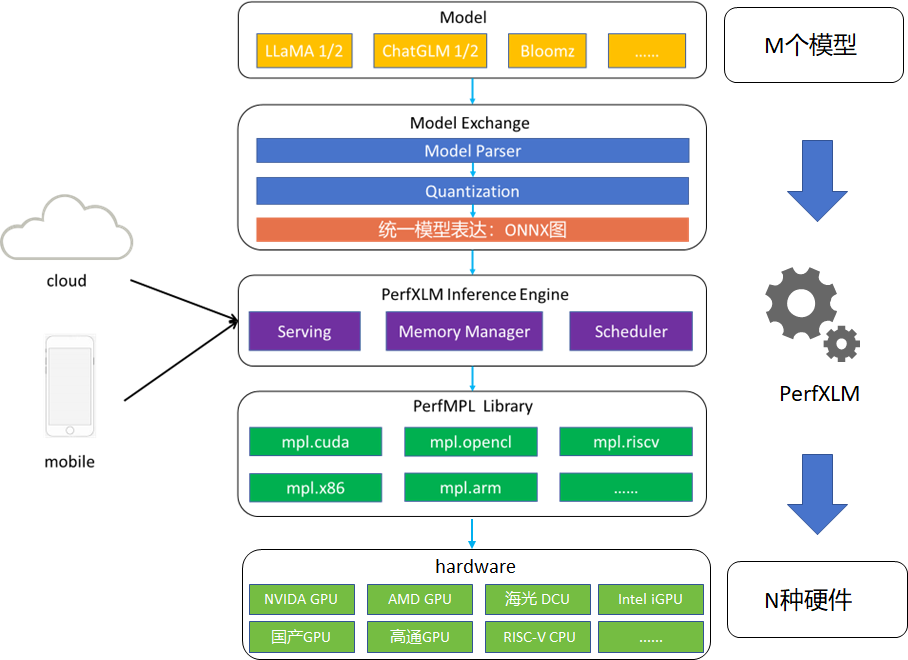

澎峰科技高性能大模型推理引擎PerfXLM解析

OpenAI開啟推理算力新Scaling Law,AI PC和CPU的機(jī)會來了

Arm CPU如何推動AI創(chuàng)新

基于CPU的大型語言模型推理實(shí)驗(yàn)

AI推理CPU當(dāng)?shù)溃珹rm驅(qū)動高效引擎

AI推理CPU當(dāng)?shù)溃珹rm驅(qū)動高效引擎

評論